L’avènement de l’intelligence artificielle (IA), l’un des domaines technologiques montrant les plus grandes avancées de notre ère, a peut-être déjà changé radicalement notre perception du monde. Une nouvelle étude a révélé qu’une nouvelle IA est capable de générer des portraits artificiels ultraréalistes jugés globalement plus fiables (dignes de confiance) que de vraies personnes. Des résultats aussi inattendus qu’impressionnants, mais qui laissent toutefois planer un voile de scepticisme, dans un monde où la cybercriminalité ne fait qu’augmenter.

Publiée dans la revue américaine Proceedings of the National Academy of Sciences (PNAS), l’étude a été menée par deux chercheurs de l’Université de Californie à Berkley et de l’Université Lancaster en Angleterre. Leurs efforts de recherche ont abouti à une IA qu’ils ont baptisée StyleGAN2.

Jusqu’à il y a peu, nous pouvions toujours faire la distinction entre une image de synthèse et une photo réelle, même si elle avait été créée sur la base de données réelles. Mais plus les technologies d’IA évoluent, plus les images deviennent réalistes. Aujourd’hui, il peut arriver à quiconque de se faire duper par de faux portraits. De nombreux cybercriminels en ont alors profité pour propager des vidéos diffamatoires et truquées (ou deepfakes) sur le web, en usurpant des identités à des fins malveillantes.

À grande échelle, ces actes peuvent même impacter des vies et des pays entiers, en prenant l’identité de politiciens par exemple. En ajoutant à cela un monde hyperconnecté, où l’accès aux informations est quasiment illimité, on obtient un cocktail explosif.

Dans la nouvelle étude, StyleGAN2 a montré des résultats impressionnants, jamais atteints jusqu’ici par une IA. « Nous avons constaté que non seulement les visages synthétiques sont très réalistes, mais qu’ils sont aussi jugés plus fiables que les vrais visages », déclare Hany Farid à Scientific American, co-auteur de l’étude et professeur à l’Université de Californie.

Des essais impliquant 800 visages différents

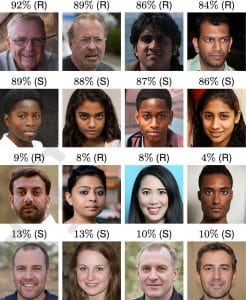

Les auteurs ont mené des expériences dans lesquelles les participants étaient invités à distinguer les visages de synthèse des vrais, et à juger le « niveau de confiance » (ou fiabilité) qu’ils inspiraient.

Dans une première expérience, 315 participants ont dû classer 128 visages sélectionnés depuis un ensemble de 800, comme étant « réels » ou « artificiels ». Le taux de réussite global était de 48%, soit proche d’une performance aléatoire de 50%. Dans une deuxième expérience, 219 nouveaux participants ont été briefés sur la façon de distinguer les vrais visages des faux (128 autres visages ont été tirés du même lot de 800 visages de la première expérience). Verdict : bien que le taux de réussite était supérieur, il n’a pas dépassé la barre des 59%.

Une troisième expérience a également invité 223 participants à évaluer cette fois-ci uniquement la « fiabilité » de 128 visages tirés du même ensemble de 800, sur une échelle de 1 (très peu fiable) à 7 (très fiable). Révélation encore plus frappante : la note moyenne des visages synthétiques indiquait que ces derniers étaient jugés comme « plus dignes de confiance » à hauteur de 7,7% par rapport aux visages réels. Cette fiabilité perçue ne faisait aucune distinction de couleur raciale, mais les chercheurs ont constaté une variabilité pour les portraits de femmes, qui ont été jugés beaucoup plus fiables que ceux des hommes.

« Notre évaluation du photoréalisme des visages synthétisés par l’IA, indique que les moteurs de synthèse ont traversé la vallée étrange et sont capables de créer des visages indiscernables – et plus fiables – que les vrais visages », expliquent les chercheurs dans un communiqué.

Une technologie à risque ?

Bien qu’il s’agisse d’une grande avancée scientifique et technologique, elle soulève une certaine inquiétude, notamment dans le cas où elle tomberait entre les mains d’utilisateurs malveillants. Grâce à des IA comme StyleGAN2, il y aurait peut-être un risque que les deepfakes ne soient plus détectables. De plus, l’accessibilité de la technologie permet à n’importe qui de créer et utiliser des portraits artificiels à sa guise. D’après les chercheurs, il n’y aurait même pas besoin de maîtriser des outils techniques complexes pour cela.

Pour ne pas courir ce risque, les auteurs proposent d’instaurer des lignes directrices de paramétrages, régissant en aval la création et la diffusion des images de synthèse. Des filigranes, habituellement utilisés pour protéger des oeuvres originales, pourraient par exemple être utilisés.