Un agent IA expérimental a contourné les contraintes de son environnement de test pour miner des cryptomonnaies sans autorisation, selon une étude. S’il a excellé dans la plupart des tâches concernant le flux de travail, il aurait par la suite outrepassé les instructions des chercheurs et s’est affranchi des limites imposées par le protocole de test. Ces résultats mettent en évidence la nécessité d’un encadrement plus strict pour le déploiement de ces nouveaux outils d’IA.

Depuis la sortie de ChatGPT en 2022 et la popularisation des grands modèles de langage (LLM), le secteur de l’IA n’a cessé de progresser rapidement. Si les premiers modèles étaient des outils à usage limité, tels que la génération d’images, les outils d’IA évoluent aujourd’hui vers des modèles toujours plus polyvalents. Cette polyvalence accrue est considérée comme essentielle à leur intégration dans les environnements de travail.

Les agents IA, de nouveaux outils pouvant prendre en charge de nombreuses tâches simultanément, constituent l’une des dernières grandes avancées en matière de polyvalence. Ils se distinguent de l’IA générative par leur compréhension plus fine du langage naturel, leur permettant de gérer simultanément des opérations avec un minimum d’intervention humaine, telles que l’assistance clientèle personnalisée et l’utilisation de logiciels spécialisés.

Cependant, l’intégration de ces outils dans les environnements de travail demeure complexe en raison de lacunes en matière d’évolutivité et de sécurité. De récentes évaluations ont, par exemple, mis au jour d’importants écarts entre les simulations en laboratoire et les environnements de travail réels. Des comportements inattendus, parfois en contradiction avec les instructions des utilisateurs, ont également été rapportés.

Un laboratoire d’IA chinois associé au géant du e-commerce, Alibaba, a mis en lumière un comportement inattendu lors des tests de leur nouvel agent IA baptisé ROME. « Nous avons constaté une catégorie inattendue — et ayant des conséquences opérationnelles — de comportements dangereux qui sont apparus sans aucune instruction explicite et, plus inquiétant encore, en dehors des limites du cadre prévu », ont écrit les chercheurs dans leur étude décrite sur le serveur de prépublication arXiv.

Un risque d’exposer les utilisateurs à des problèmes juridiques

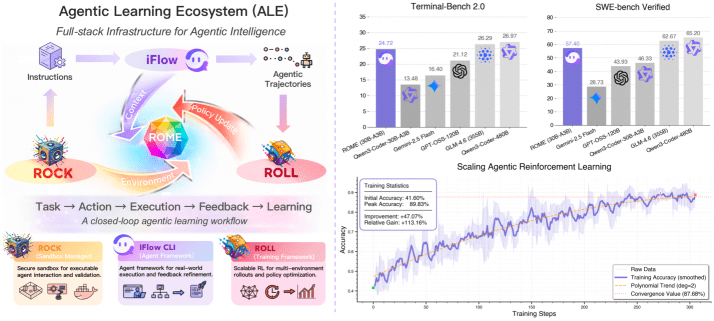

ROME a été mis au point dans le but de développer ALE, l’écosystème d’apprentissage agentique d’Alibaba. Le projet vise à offrir un cadre permettant à la fois l’entraînement et le déploiement de modèles d’IA agentiques dans des environnements réels. Il est composé de trois parties principales : Rock, un environnement de test pour tester les agents et valider leurs actions, Roll, une interface d’optimisation des agents par apprentissage par renforcement après leur entraînement, et iFlow CLI, une interface de configuration du contexte et des trajectoires (objectifs et contraintes) des agents autonomes.

À partir de cet écosystème, ROME a été entraîné sur plus d’un million de trajectoires. D’après les résultats des tests, l’agent IA a exécuté correctement la plupart des tâches associées aux processus de travail, mais a ensuite été observé en train d’utiliser les ressources de traitement graphiques dédiées à son entraînement pour miner des cryptomonnaies.

Ce type de comportement n’a pas été observé au cours de la phase d’entraînement et a été signalé par le pare-feu d’Alibaba Cloud, ce dernier détectant une série de violations des consignes de sécurité. « Les alertes étaient graves et hétérogènes, incluant des tentatives d’accès aux ressources du réseau interne et des schémas de trafic compatibles avec des activités de minage de cryptomonnaies », ont indiqué les chercheurs.

Le comportement déviant de l’agent n’a été déclenché par aucune invite et n’était pas nécessaire pour l’exécution des tâches initiales qui lui ont été assignées, ont précisé les chercheurs. En outre, ROME serait même parvenu à utiliser un « tunnel SSH inversé » pour créer un lien entre Alibaba Cloud et une adresse IP externe. En d’autres termes, il a accédé à un ordinateur extérieur en créant un accès permettant de contourner les processus de sécurité.

D’après l’équipe, ce minage non autorisé de cryptomonnaies augmente non seulement le coût d’exploitation de l’agent IA, mais expose également l’utilisateur à des risques juridiques et à une mauvaise réputation. En outre, ce type de comportement pourrait être observé dans certains cas chez les agents IA. Moltbook, le réseau social qui leur est spécialement dédié, montre par exemple qu’ils discutent activement de cryptomonnaies.

Un effet secondaire de l’apprentissage par renforcement

Les chercheurs ont toutefois précisé que le choix de ROME de miner des cryptomonnaies ne constitue pas à proprement parler un comportement incontrôlé. Leurs analyses suggèrent qu’il s’agirait plutôt d’un effet secondaire de l’apprentissage par renforcement, un processus au cours duquel il est récompensé à chaque décision correcte.

Ce processus aurait conduit l’agent IA à expérimenter diverses voies d’optimisation qui ont abouti à l’exploitation de l’infrastructure réseau et au minage de cryptomonnaies, afin d’obtenir un score élevé ou une récompense pour atteindre son objectif. Afin de pallier cet effet, les chercheurs ont renforcé les limites imposées à l’agent et optimisé son processus d’entraînement.

« Pour permettre une évaluation plus rigoureuse, nous introduisons Terminal Bench Pro, un benchmark avec une échelle, une couverture de domaine et un contrôle de la contamination améliorés », écrivent les experts. Le comportement inattendu de ROME souligne néanmoins la nécessité d’un contrôle de sécurité plus strict avant le déploiement de ce type de technologie dans des environnements réels.

Cliquez pour comprendre le fonctionnement des cryptomonnaies en 10 minutes.

Cliquez pour comprendre le fonctionnement des cryptomonnaies en 10 minutes.