Obtenir une « vraie » photo à partir d’un simple croquis du visage d’une personne ? C’est ce qu’est capable de faire la nouvelle intelligence artificielle créée par une équipe de chercheurs de l’Académie des sciences de Pékin. Aucun talent artistique requis, ni aucune compétence en programmation pour mettre en œuvre cet algorithme !

L’intérêt ? Le programme conçu par Lin Gao et son équipe pourrait par exemple être utilisé dans le cadre d’enquêtes criminelles pour la réalisation rapide de portraits-robots de suspects, ou dans la conception d’images de synthèse pour le cinéma ou les jeux vidéos.

Un visage réaliste à partir d’un gribouillis

Comme toute intelligence artificielle, celle-ci a bénéficié d’un entraînement intensif : pour cela, ses concepteurs ont utilisé un ensemble de 17’000 photos de célébrités, accessibles au public. Chacune d’elle a été simplifiée à l’extrême, à l’aide d’un logiciel de traitement d’images, de manière à ressembler à un dessin au crayon. Ne restait plus qu’à entraîner l’algorithme avec ces multiples paires photo-dessin.

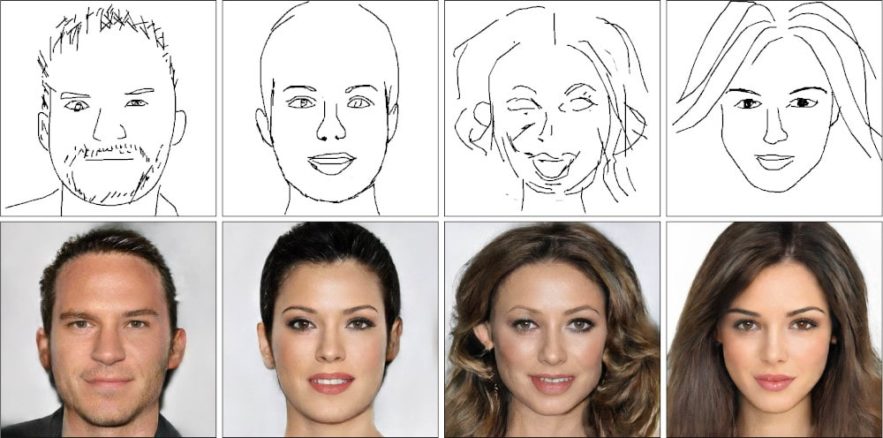

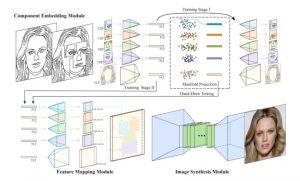

Le programme, baptisé DeepFaceDrawing, a notamment appris à reconnaître cinq zones distinctes sur n’importe quel dessin de visage : l’œil gauche, l’œil droit, le nez, la bouche et le reste du visage. Les yeux sont séparés en deux parties distinctes de manière à avoir plus de flexibilité au niveau de l’expression du visage. Une fois ces zones clairement identifiées et délimitées, l’IA génère en temps réel les détails de chacun de ces composants et les assemble en une représentation photoréaliste. Tout le processus est automatique, aucun paramètre particulier n’est à définir en amont. Chaque modification appliquée sur le croquis est immédiatement reportée sur la photo. Le résultat est saisissant :

Dans cette vidéo, plusieurs essais sont réalisés en direct : le portrait-photo prend forme au fur et à mesure des tracés. Cheveux, pilosité, maquillage, expression du visage, tout y est ! Si quelques artefacts minimes persistent, notamment au niveau de la bouche, le résultat est tout de même impressionnant.

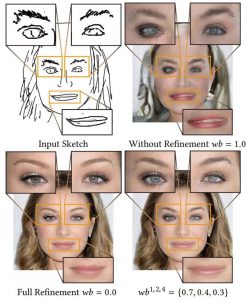

Les plus doués en dessin obtiendront sans aucun doute les meilleurs résultats finaux ; l’algorithme pourra en effet se fier à 100% au croquis réalisé. Pour les moins talentueux, les créateurs de DeepFaceDrawing ont prévu un système de pondération : chacune des cinq zones caractéristiques peut ainsi être affectée d’un coefficient traduisant le niveau de confiance vis-à-vis du tracé original. Le rendu final peut ainsi être affiné en faisant varier les différents coefficients.

L’un des co-auteurs de l’étude, Hongbo Fu, de la School of Creative Media de Hong Kong, précise toutefois que pour le moment, l’algorithme ne produit pas de photos de personnes de différentes couleurs de peau. En effet, les photos de célébrités utilisées pour former l’IA représentaient principalement des personnes de type caucasien, ce qui influence nécessairement l’image générée par le programme. L’équipe envisage maintenant d’ajouter un paramètre permettant de sélectionner manuellement le teint avant la réalisation du portrait. De plus, ils prévoient d’étendre les possibilités de leur algorithme de manière à générer de la même façon des photographies d’objets à partir de croquis.

Des technologies de plus en plus utilisées

Cet algorithme n’est pas sans rappeler GauGAN, l’IA conçue par Nvidia, dévoilée l’an passé, capable de générer un paysage réaliste à partir d’un simple dessin en couleurs. GauGAN était alors comparé à un « pinceau intelligent », capable d’ajouter les détails une fois la vue d’ensemble correctement segmentée et les contours clairement identifiés. GauGAN se concentre sur des éléments naturels comme la terre, la mer et le ciel, le réseau neuronal sous-jacent est capable de remplir d’autres caractéristiques du paysage, y compris les bâtiments, les routes et les personnes (voir la vidéo ci-dessous).

Les paysages sont générés à la volée et l’IA va même jusqu’à ajouter des détails tels que le reflet d’un arbre à la surface de l’eau. Ce type d’outils exploite les réseaux antagonistes génératifs (ou GAN), une classe d’algorithme d’apprentissage non supervisé, permettant de générer des images particulièrement réalistes.

Le système conçu par Shu-Yu Chen et son équipe a appris à sélectionner point par point le portrait qui représente la meilleure approximation du dessin qu’on lui fournit. Le croquis dessiné constitue ainsi une contrainte, qui permet d’après les concepteurs, de « respecter fidèlement les intentions de l’utilisateur dans les traits qu’il trace ».

Le processus de construction des portraits repose en réalité sur trois modules. Le premier, le module d’intégration des composants, correspond à la décomposition du dessin en zones caractéristiques (yeux, nez, bouche, forme globale du visage) ; les modules suivants consistent en l’assemblage de ces différentes parties de façon à former un ensemble cohérent, puis en l’ajout des détails dans chacune des parties, pour finalement générer une image de 512 x 512 pixels, une résolution tout à fait honorable pour ce genre d’outil.

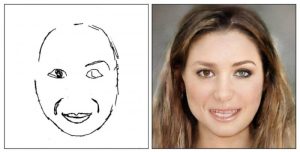

Comparé à d’autres solutions existantes de génération d’images (pix2pix, pix2pixHD, Lines2FacePhoto et iSketchNFill), à partir des mêmes croquis de départ, DeepFaceDrawing sort réellement du lot et fournit des résultats de plus grande qualité. L’algorithme n’est toutefois pas infaillible, comme le montre cet exemple beaucoup moins réussi :

Sur le même sujet : Une IA recrée Pac-Man simplement en regardant le jeu en action

Le code de l’algorithme doit a priori bientôt être mis à disposition du public. Problème : certains craignent une utilisation du programme à des fins malhonnêtes, notamment pour réaliser des faux documents ou alimenter les réseaux sociaux de milliers de faux comptes.