Meta (anciennement Facebook) est en pleine expansion de sa branche dédiée à l’intelligence artificielle, craignant d’être laissée loin derrière par les leaders actuels, dont OpenAI, Google et Microsoft. L’enseigne a récemment lancé Imagine, une nouvelle IA visant à rivaliser avec DALLE-3, Stable Diffusion ou encore Midjourney. Le modèle derrière le système aurait été entraîné avec plus d’un milliard d’images publiques provenant de Facebook et Instagram.

En septembre dernier, Meta a enrichi ses applications de plusieurs fonctionnalités basées sur l’IA. Parmi celles-ci, un générateur d’autocollants nommé « Imagine », activable à partir d’un prompt sur Messenger, WhatsApp ou Instagram. Les stickers générés peuvent ensuite être envoyés dans les discussions à la manière des autocollants ordinaires. Toutefois, peu après son lancement, Imagine a suscité la controverse en autorisant la création d’images de toutes sortes, sans restrictions.

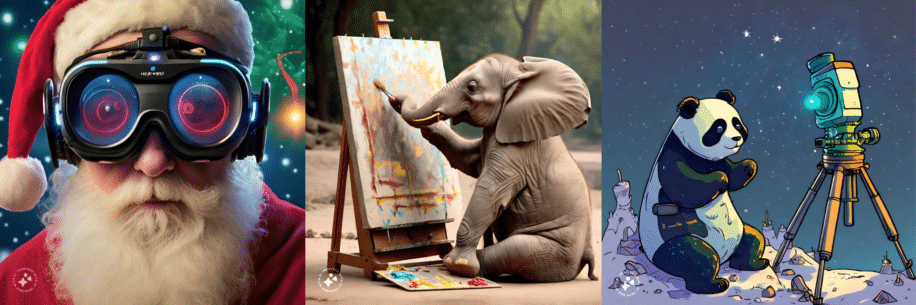

Malgré cela, Meta a choisi d’étendre l’accès à ce générateur d’images au-delà de ses plateformes. « Nous avons apprécié les commentaires de nos utilisateurs sur la façon dont ils utilisent Imagine, la fonctionnalité de génération d’images à partir de texte de Meta AI, pour créer des contenus amusants et créatifs. Aujourd’hui, nous élargissons l’accès à Imagine en dehors de messenger », déclare Meta dans un communiqué de presse publié mercredi. Pour le moment, Imagine est uniquement accessible, gratuitement, depuis les États-Unis, depuis l’adresse imagine.meta.com.

Imagine, nouveau concurrent de Stable Diffusion, DALL-E 3 et Midjourney

Imagine, à l’instar de ses concurrents tels que Stable Diffusion, DALL-E 3 et Midjourney, génère des images en réponse à des invites textuelles en utilisant un modèle génératif. Pour l’utiliser, il est nécessaire de posséder un compte Meta, qui peut être créé à partir de comptes Facebook ou Instagram existants. Chaque requête génère quatre images distinctes avec une résolution de 1280×1280 pixels.

Toutes les œuvres générées portent un filigrane « Imagined with AI » dans le coin inférieur gauche. Cependant, Meta prévoit de développer un filigrane invisible qui permettra de retracer les images générées par son IA. L’objectif est d’assurer la distinction entre les œuvres humains et celles de l’IA. Comme l’assure Meta, ce filigrane résistera « aux manipulations d’image courantes telles que le recadrage, le changement de couleur, les captures d’écran, etc. ». Cette innovation semble la bienvenue à en croire les premiers retours d’utilisateurs ou d’experts.

Concernant les aspects de sécurité, nos essais confirment que le système exclut les contenus injurieux, violents ou sexuels. Il filtre également les noms de célébrités et de figures historiques.

Des données issues de Facebook et Instagram

Le modèle génératif d’Imagine est baptisé « EMU » (Expressive Media Universe). L’une de ses différences majeures par rapport aux autres IA de génération d’images est le fait qu’Imagine a été exclusivement entraîné avec des images puisées sur les réseaux sociaux de Meta. C’est notamment ce qu’avait confirmé Nick Clegg, président des affaires mondiales chez Meta, lors d’une interview avec Reuters il y a quelques mois. Toutefois, l’entreprise assure n’avoir exploité que des données publiques, excluant ainsi celles partagées dans un cadre privé.

EMU a été entraîné avec 1,1 milliard d’images en suivant un processus appelé « quality-tuning », qui différerait des méthodes d’entraînement habituelles pour ce type de système. Cette technique permet davantage les améliorations de la qualité visuelle des images avec une même quantité de données, plutôt que de nécessiter forcément plus de données pour augmenter la qualité. L’équipe de Meta AI a aussi utilisé ce qu’on appelle « l’alignement esthétique ». Cette méthode permet d’affiner la pertinence des images, non seulement par rapport aux prompts, mais aussi par rapport à l’esthétique.