La pandémie de COVID-19 a de lourdes conséquences, mais l’une d’entre elles est pour le moins inattendue. Il se trouve que la situation inédite que nous vivons à l’échelle mondiale, associée aux incertitudes qui entourent la maladie (son évolution, sa propagation) ont mis à mal les algorithmes d’intelligence artificielle qui sont chargés d’analyser notre comportement en ligne…

Par exemple, les algorithmes qui sont programmés pour nous recommander des produits sur Amazon peinent à interpréter nos nouveaux modes de vie. Les technologies de machine learning sont pourtant conçues pour engranger et interpréter sans cesse de nouvelles données ! Il se pourrait qu’elles ne soient finalement pas si infaillibles que ça…

Des prédictions non adaptées à cette situation inhabituelle

En cette période de confinement plus ou moins strict, les anomalies observées parmi les modèles d’apprentissage automatique sont légion, notamment parmi ceux liés à la gestion des stocks, à la détection des fraudes ou au marketing.

Par exemple, une entreprise chargée de détecter les usages frauduleux de cartes bancaires a dû adapter son algorithme de manière à ce qu’il ne donne pas l’alerte en cas d’intérêt (et d’achat) soudain pour des équipements de jardinage ou de bricolage. Un commerçant indien a constaté, quant à lui, que son intelligence artificielle avait commandé un stock de produits qui ne correspondait plus du tout à ce qu’il vendait réellement à ses clients détaillants ; l’algorithme s’était appuyé sur des prévisions de ventes biaisées. Enfin, une firme spécialisée en conseils d’investissements, dont l’IA se base sur l’analyse des sentiments des articles de presse, a été perturbée par le ton global (très négatif), qui émanait des différents médias.

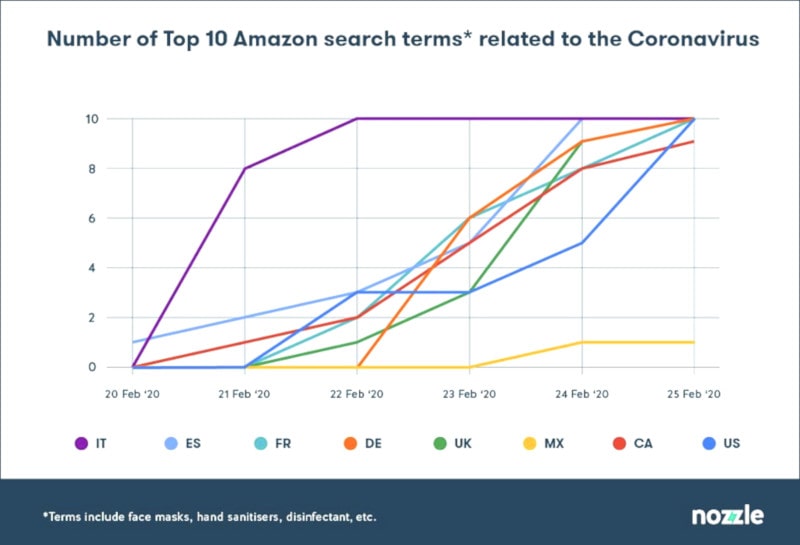

Effectivement, au fur et à mesure que la pandémie progressait, nos habitudes d’achat ont complètement changé. Les produits qui constituaient les piliers du top 10 d’Amazon (tels que les coques et chargeurs de téléphone ou les boîtes de Lego) ont été oubliés d’un claquement de doigts, pour être remplacés par des achats bien plus adaptés à la situation… Il a fallu moins d’une semaine pour que les 10 principaux termes de recherche sur Amazon, dans plusieurs pays, soient liés au coronavirus. Le phénomène est illustré par le graphique suivant :

Dans la semaine du 12 au 18 avril, le top 10 des requêtes formulées sur le site d’Amazon était : « papier toilette », « masque facial », « désinfectant pour les mains », « serviettes en papier », « vaporisateur Lysol », « lingettes Clorox », « masque », « Lysol », « masques pour la protection contre les germes » et « masque N95 » (ndlr : Lysol et Clorox sont des marques courantes de produits d’entretien outre-Atlantique). Et le taux de conversion était exceptionnellement élevé ! En d’autres termes, la plupart des visiteurs ne font pas que rechercher, ils achètent en masse (un pack de 50 masques jetables vendu sur le site est rapidement devenu un best-seller…).

Le plus difficile, comme l’explique Rael Cline, CEO de l’entreprise Nozzle – une société de conseil basée à Londres spécialisée dans les algorithmes publicitaires pour les vendeurs Amazon – c’est que la tendance peut complètement changer à tout moment : « La semaine dernière, vous essayiez de vous adapter à la demande croissante en papier toilette, et cette semaine, tout le monde veut des puzzles et des équipements de gym ! ».

Les IA doivent être entraînées aux pires scénarios

Formés à partir du comportement « normal » des individus, les modèles d’apprentissage automatique ont donc été quelque peu perturbés ces derniers temps, révélant au passage leurs failles jusqu’à présent ignorées. Ainsi, selon Pactera EDGE, une société de conseils spécialisée en IA, « l’automatisation est en chute libre ». D’autres experts sont moins fatalistes et tentent de maintenir les systèmes intelligents à flot, en apportant les corrections qui s’imposent. En effet, face à ces difficultés inattendues, certaines entreprises ont mobilisé plus de temps et de ressources pour réorienter manuellement la prise de décision des algorithmes.

La société londonienne Phrasee a ainsi parfaitement fait face à la situation. Spécialisée dans la génération automatique de campagnes publicitaires par mail ou sur Facebook, basées sur le comportement des clients, elle utilise des algorithmes conçus pour trouver le ton le plus adapté ; des employés humains sont toutefois chargés de vérifier les textes créés par l’IA. Dès l’arrivée du COVID-19, la société a entrepris de bannir certains termes liés à la situation, qui pourraient générer de l’anxiété (« going viral », « be prepared », « OMG », etc.) ou toute évocation à des activités ou des divertissements désormais non permis. Idem du côté des emojis : terminé les frimousses trop réjouissantes ou trop alarmistes ! Phrasee a tout fait pour que ses publicités n’angoissent pas davantage ses clients…

D’autres voient dans cette situation l’opportunité d’améliorer le système de façon plus durable. Car les modèles d’apprentissage sont fragiles : ils fonctionnent mal lorsque les données d’entrée sont soudainement très différentes de celles à partir desquelles ils ont été formés. Selon Rajeev Sharma, vice-président de Pactera EDGE, c’est une erreur de croire qu’on peut les laisser évoluer complètement seuls une fois mis en place. Il évoque, à titre d’exemple, une célèbre société de streaming, qui face à l’afflux soudain de nouveaux abonnés et à l’augmentation de la consommation de contenus, a constaté une défaillance de ses algorithmes de recommandation. Les contenus proposés se sont avérés de moins en moins pertinents, car le comportement des abonnés changeait en permanence…

Sur le même sujet : Une IA qui évolue d’elle-même par « sélection naturelle »

De ce fait, l’expert pense que les IA devraient être entraînées non seulement sur « les hauts et les bas » des dernières années, mais aussi sur des événements « anormaux », tels que la Grande Dépression des années 1930, le krach boursier d’octobre 1987 (le Black Monday) ou encore la crise financière de 2007-2008. « Une pandémie comme celle-ci est le parfait déclencheur pour construire des modèles de machine learning plus performants », affirme Sharma.

La pandémie a mis en exergue de nombreuses failles de notre société : des failles institutionnelles et logistiques, des problèmes économiques et d’approvisionnement liés à la mondialisation et à la « métropolisation »… Elle a également révélé à quel point l’intelligence artificielle était entrée subrepticement dans nos vies, construisant peu à peu une certaine co-dépendance : aujourd’hui, les changements de notre comportement modifient le fonctionnement de l’IA, et les changements au niveau de l’IA modifient notre comportement. Rael Cline souligne toutefois que la situation nous rappelle surtout que l’implication de l’humain dans les systèmes automatisés demeure essentielle.