Des chercheurs de l’Université de Cambridge ont récemment dévoilé un système d’intelligence artificielle qui, en adoptant des contraintes physiques analogues au cerveau humain, a développé une capacité d’auto-organisation similaire. Cette innovation promet des avancées qui favoriseront le développement d’IA plus efficientes et constitue peut-être un pas de plus vers la tant convoitée intelligence artificielle générale (IAG), sur laquelle des leaders du domaine, dont OpenAI, travaillent d’arrache-pied.

À mesure que les systèmes neuronaux s’organisent et établissent des connexions, ils doivent équilibrer des demandes concurrentes. De l’énergie et des ressources sont nécessaires pour développer et maintenir le réseau dans l’espace physique, tout en optimisant ce dernier pour le traitement de l’information. Ce compromis façonne tous les cerveaux au sein des espèces et entre elles, ce qui peut expliquer pourquoi de nombreux cerveaux convergent vers des solutions organisationnelles similaires.

L’intelligence artificielle (IA) a peut-être franchi un nouveau cap, se rapprochant un peu plus de la complexité et de l’efficacité du cerveau humain, grâce au travail de chercheurs de l’Université de Cambridge. Ces derniers ont récemment développé un système d’IA qui, sous des contraintes physiques similaires à celles du cerveau, démontre une capacité d’auto-organisation remarquable. Cette avancée, détaillée dans la revue Nature Machine Intelligence, soulève des questions fondamentales sur les liens entre la structure et la fonction cérébrale tout en ouvrant de nouvelles voies pour la conception de systèmes d’IA plus efficaces.

L’auto-organisation de l’IA : un miroir du cerveau humain

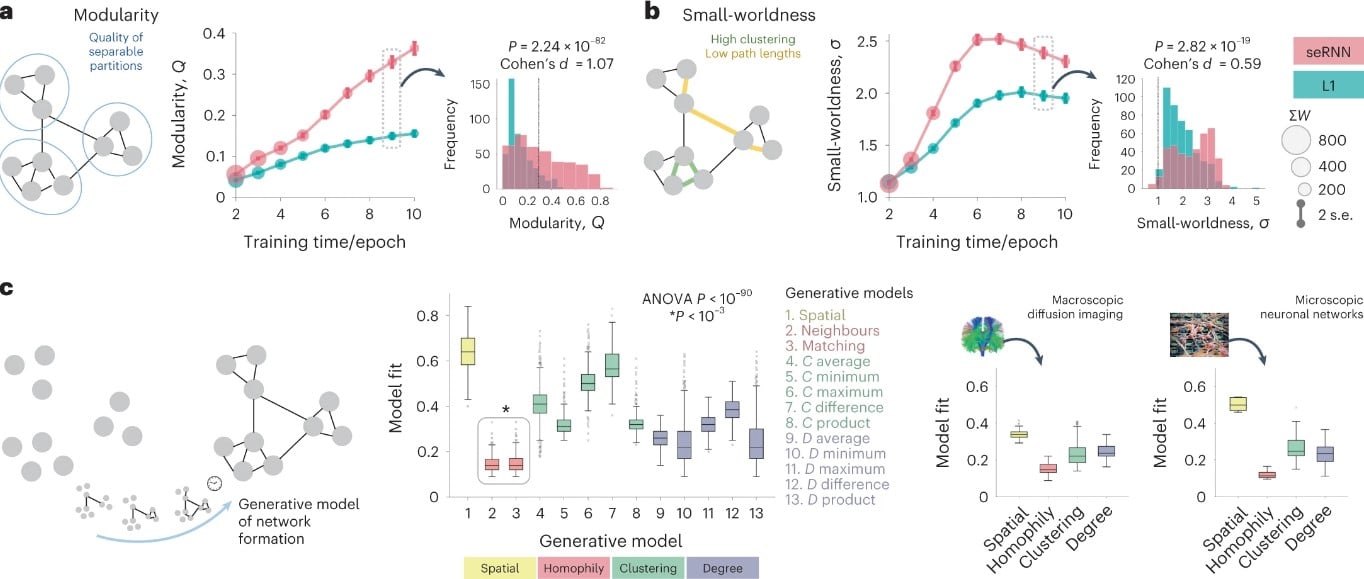

Les chercheurs expliquent dans un communiqué avoir développé un système d’IA basé sur des réseaux neuronaux récurrents spatialement intégrés (seRNNs). Ces réseaux sont conçus pour imiter la structure et le fonctionnement du cerveau humain, en intégrant des éléments qui reproduisent les contraintes physiques et biologiques auxquelles le cerveau est soumis.

En effet, dans le cerveau humain, les neurones sont limités par des contraintes physiques et biologiques telles que la distance (entre les neurones) et la quantité d’énergie disponible pour établir et maintenir des connexions, comme susmentionné.

Pour tester leur système d’IA, les chercheurs ont choisi une tâche de navigation dans un labyrinthe, similaire à ceux utilisés dans les études comportementales sur des animaux comme les rats et les macaques. Le système d’IA devait déterminer le chemin le plus court pour atteindre un point final, en combinant plusieurs informations : le point de départ, le point d’arrivée et les étapes intermédiaires.

Cette tâche nécessitait que le système retienne et traite ces éléments pour réussir. Une fois la tâche maîtrisée, il était possible d’analyser quels nœuds du réseau étaient actifs à différents moments, permettant ainsi d’identifier ceux qui codent pour des aspects spécifiques, comme les emplacements d’arrivée ou les itinéraires possibles.

Initialement, le système commettait des erreurs dans l’exécution de la tâche, mais il s’améliorait progressivement grâce au feedback, ajustant la force des connexions entre ses nœuds, à l’instar des cellules cérébrales qui modifient leurs connexions lors de l’apprentissage. Cependant, une contrainte physique imposée au système rendait la création de connexions entre des nœuds éloignés plus difficile, simulant ainsi les coûts énergétiques des connexions à longue distance dans le cerveau humain.

En réponse à cette contrainte, le système a développé des hubs, soit des nœuds hautement connectés facilitant la transmission d’informations. De plus, ces nœuds ont adopté un système de codage flexible, où un même nœud pouvait représenter différentes propriétés du labyrinthe à différents moments, une caractéristique également observée dans le cerveau d’organismes complexes.

Implications pour la neuroscience et la santé mentale

Cette étude transcende la simple amélioration des systèmes d’intelligence artificielle. En examinant l’impact des contraintes physiques, telles que la distance entre les neurones et les limites énergétiques, sur le développement et le fonctionnement du cerveau, les chercheurs acquièrent des connaissances précieuses sur les processus cognitifs, même humains. Cette recherche pourrait révéler comment le cerveau surmonte ces contraintes pour traiter l’information, apprendre et s’adapter, offrant des éclairages sur les variations individuelles des capacités cognitives et les causes potentielles de certains troubles cognitifs ou mentaux.

D’autre part, l’application de ces contraintes physiques aux systèmes d’IA permet d’étudier les différences entre les cerveaux humains et de simuler les effets de variations structurelles sur le fonctionnement cognitif. Cette approche pourrait fournir des indices sur les manifestations neuronales de conditions telles que l’autisme, la dyslexie ou la schizophrénie. De plus, en analysant comment l’IA s’adapte sous ces contraintes, les chercheurs pourraient proposer des traitements plus ciblés et efficaces.

Vers des systèmes d’IA plus économes ?

En s’inspirant de la structure et des contraintes du cerveau humain, le système d’IA développé par les chercheurs de Cambridge se montre plus efficace, nécessitant notamment moins de ressources pour son fonctionnement. Cette innovation est particulièrement pertinente pour les appareils et systèmes où l’efficacité énergétique est essentielle.

Elle ouvre également la voie à des modèles d’IA inspirés du cerveau, potentiellement plus flexibles et adaptatifs que les systèmes actuels, surtout dans des tâches complexes. Il s’agit en d’autres termes de systèmes plus durables et adaptés aux défis réels. Finalement, ce type de système nous rapproche peut-être un peu plus de la véritable intelligence artificielle générale (IAG).