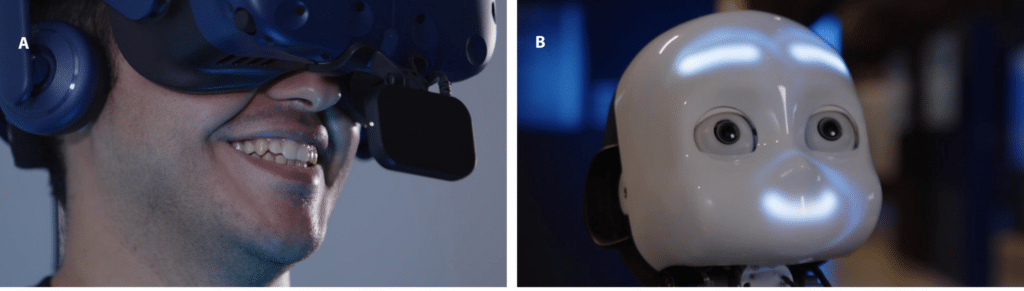

Pilotable à distance via Internet, le robot humanoïde iCub 3 se synchronise parfaitement avec son opérateur. Il imite fidèlement les mouvements et expressions faciales de l’opérateur. Équipé d’un casque de réalité virtuelle et de gants à retour haptique, ce dernier perçoit visuellement et tactilement l’environnement du robot, créant une expérience immersive complète.

iCub est un robot humanoïde de la taille d’un enfant de 4 ans (100 cm) conçu principalement pour la recherche en robotique cognitive et l’interaction homme-machine. Lancé en 2006, ce projet international a impliqué de nombreuses entités de recherche européennes, coordonnées par l’Istituto Italiano di Tecnologia (IIT), un institut technologique de renom en Italie.

Au fil des ans, iCub a évolué à travers plusieurs versions, chacune apportant des améliorations et de nouvelles fonctionnalités. La version la plus avancée à ce jour est l’iCub 3. Les dernières avancées technologiques ont permis à cette dernière d’offrir une expérience sensorielle complète, incluant des modalités visuelles, auditives, haptiques et tactiles.

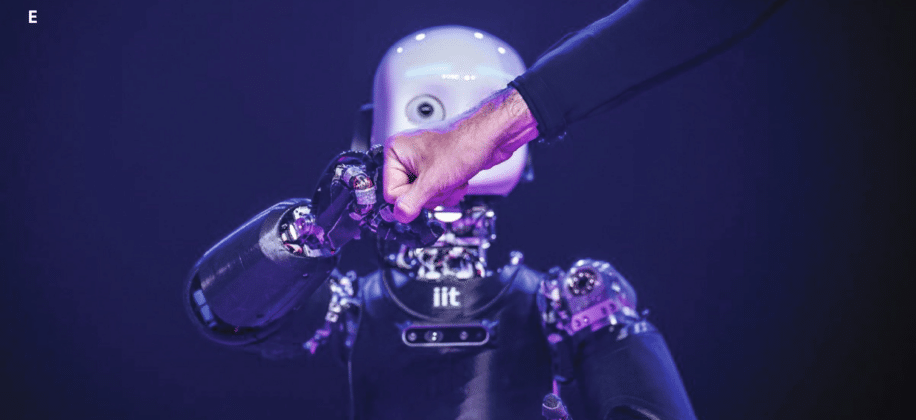

Cette innovation donne la possibilité à un utilisateur de voir et de sentir l’environnement direct du robot, même s’il se trouve à des centaines de kilomètres. Pour démontrer ces capacités, l’équipe de l’IIT a mené une expérience à la Biennale de Venise. Dans cette expérience, un opérateur situé à Gênes, soit à une distance de 290 kilomètres, a pu vivre une expérience immersive en contrôlant iCub 3 et en recevant en temps réel des images et des sensations tactiles depuis les locaux de l’exposition. Les détails de cette technologie ont été publiés récemment dans la revue Science Robotics.

Comment fonctionne le robot iCub 3 ?

Pesant tout de même 52 kg malgré sa taille enfant, iCub 3 est équipé d’une multitude de capteurs répartis sur tout son corps. Ces derniers lui permettent de mesurer toute interaction tactile, telle que le toucher et la pression. Le robot est également doté de caméras au niveau des yeux. Les données recueillies, comprenant les images et les informations tactiles, sont transmises en temps réel à l’opérateur. Celui-ci utilise un casque de réalité virtuelle pour obtenir une perspective en première personne de l’environnement du robot et porte des gants à retour haptique, qui reproduisent les sensations perçues par les capteurs du robot. Ainsi, l’opérateur peut « sentir » ce que le robot touche.

Les mouvements de l’opérateur sont capturés par des capteurs et transmis à iCub 3. Grâce à ses 54 points d’articulation, le robot peut reproduire fidèlement les gestes humains, permettant un contrôle précis. L’utilisateur ne se contente pas de diriger les mouvements et déplacements d’iCub 3, il peut également contrôler ses expressions faciales, ajoutant une dimension émotionnelle significative à l’interaction.

Les limites d’iCub 3

Ces intégrations technologiques permettent à iCub 3 de se substituer physiquement à une personne dans un lieu spécifique. Grâce à la transmission de données via Internet, la distance entre l’opérateur et le robot n’est plus une contrainte majeure. Cependant, iCub 3 présente certaines limites. Les experts soulignent un manque de robustesse. En cas de chute, le robot peut subir des dommages significatifs, sans compter le fait qu’il n’est pas garanti qu’il puisse se relever seul.

En outre, les chercheurs ont relevé une latence d’environ 100 millisecondes dans l’interaction, mais ils estiment que cela peut être « compensé » en effectuant des mouvements suffisamment lents. Enfin, dans le cadre de cette première expérience, les scientifiques n’ont pas pu établir la bande passante minimale pour le fonctionnement optimal d’iCub 3. Cette information est pourtant cruciale pour assurer son bon fonctionnement, surtout dans des environnements où la connectivité est limitée ou instable.