Malgré les récents événements le concernant, le PDG d’OpenAI, Sam Altman, demeure fermement engagé envers sa vision d’une progression accélérée de l’entreprise — et par extension de l’IA. Cette approche a pourtant été perçue par certains comme la cause principale de son licenciement par le conseil d’administration il y a trois semaines. Altman, de son côté, est persuadé que cette cadence rapide est essentielle pour révolutionner divers secteurs et faire croître l’IA.

D’après des informations de Bloomberg, suite à son licenciement puis à sa réintégration chez OpenAI, Altman s’est exprimé publiquement pour la première fois lors d’un forum à Atlanta. Les raisons précises de son éviction n’ont jamais été explicitement clarifiées par l’entreprise.

Dans sa communication officielle, OpenAI avait simplement évoqué un certain manque de franchise dans les communications du PDG, raison qui aurait motivé la décision. Toutefois, certaines spéculations suggèrent que le renvoi pourrait être lié à sa tendance à pousser l’innovation à un rythme effréné chez OpenAI, une démarche jugée par certains collaborateurs comme imprudente.

« Élever le monde »

Rétabli dans ses fonctions, Altman semble bien déterminé à continuer à diriger OpenAI de la même manière. Dans son discours, il n’a jamais évoqué le sujet de son licenciement, mais ses propos concernant les projets de l’entreprise laissent entendre que cet épisode n’influence en rien sa stratégie de développement.

Altman réaffirme ainsi son engagement envers une « approche exploratoire » pour propulser OpenAI. Cette stratégie implique d’innover et surtout de repousser les limites de la technologie actuelle. Il a souligné que pour réaliser pleinement le potentiel de l’IA, des entreprises comme OpenAI doivent être prêtes à explorer de nouvelles voies et à prendre des risques calculés. Selon lui, c’est en adoptant cette démarche que l’industrie parviendra à « élever le monde », notamment grâce aux améliorations apportées ainsi à l’IA dans différents secteurs (par cette stratégie proche de « l’essai-erreur »), particulièrement la santé et l’éducation.

Gérer les risques et les opportunités de l’IA

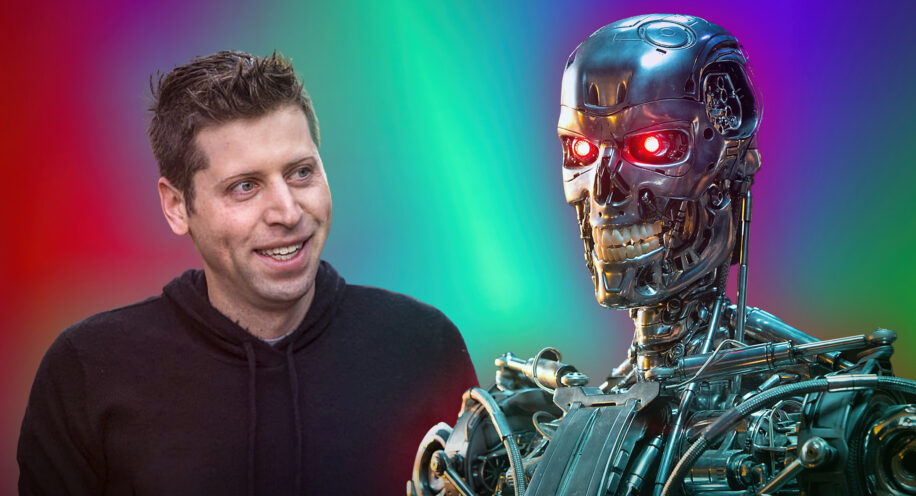

Depuis l’essor de ChatGPT, l’IA est considérée par de nombreuses personnes comme une potentielle menace, certaines allant jusqu’à avancer le risque d’éradication imminente de l’espèce humaine. Altman reconnaît que les préoccupations concernant l’usage malveillant de l’IA sont bien fondées. Il admet également comprendre les inquiétudes spécifiques à l’utilisation de l’IA pour créer des armes biologiques ou pour le piratage de systèmes informatiques. « Toutes ces réflexions sur la façon dont cela pourrait mal tourner, il n’y a pas besoin de beaucoup d’imagination, parce que nous avons grandi avec cela dans les médias », a-t-il déclaré. Cependant, Altman souligne que la réalité du développement de l’IA est bien plus maîtrisée et moins encline à conduire à des scénarios catastrophe. Curieusement, il a également déclaré qu’il était fasciné par les IA malveillantes de la science-fiction, comme les robots tueurs de la franchise Terminator.

Face aux inquiétudes, il met en avant l’engagement d’OpenAI envers la sécurité dans l’élaboration de ses modèles. Convaincu que les bénéfices de l’IA surpassent largement les risques, il insiste tout de même sur la nécessité de faire de la sécurité une priorité absolue.

Il a par ailleurs expliqué que l’entreprise favorise la transparence pour encourager un débat public sur l’utilisation de l’IA. Selon lui, c’est la raison pour laquelle les technologies de l’entreprise sont déployées de manière ouverte et à large échelle, plutôt que confinées dans un laboratoire secret.