L’IA a engendré de grands bouleversements dans pratiquement tous les domaines, y compris l’enseignement supérieur et universitaire. Cela a donné lieu à de nouvelles dynamiques à la fois pour l’apprentissage et l’enseignement. Cependant, l’intégration de la technologie dans le système académique étant un processus délicat, des préoccupations émergent quant à la performance des étudiants et l’intégrité académique. Son utilisation intensive pourrait-elle donner lieu à une génération « d’assistés cognitifs » ? Nous avons sollicité l’avis d’experts pour explorer la question.

Sections principales de l’article :

-

- Des opportunités d’apprentissage adaptatif et personnalisé ?

- Un risque de diminution de la pensée autonome et d’augmentation de la malhonnêteté académique

- Des évaluations automatisées et personnalisées en fonction des étudiants

- Efforts de réglementation en cours

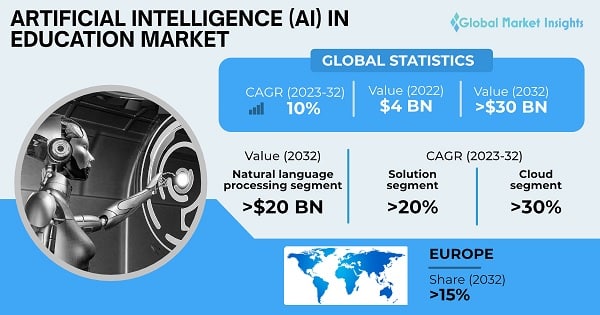

La dépendance croissante aux technologies a fait que les modèles traditionnels d’éducation sont devenus insuffisants pour soutenir le secteur. En réponse aux besoins des étudiants et des éducateurs, les entreprises spécialisées en technologies éducatives (EdTech) connaissent une croissance exponentielle. Selon Global Market Insights, l’an dernier, près de 30 EdTech licornes (jeunes entreprises de moins de 10 ans, non cotées en bourse et valorisées à plus d’un milliard de dollars) ont atteint une valeur cumulée de 89 milliards de dollars.

Cette croissance fulgurante est principalement attribuée à l’arrivée de l’IA dans le domaine de l’éducation. La valeur du marché des outils d’IA dédiés à l’éducation dans son ensemble a atteint 4 milliards de dollars en 2022 (c’est-à-dire au moment de la sortie de ChatGPT) et devrait connaître un taux de croissance annuel composé (CAGR) de 10 % entre 2023 et 2032. Le secteur des solutions d’IA dédiées à l’éducation pourrait connaître une CAGR de 20 % sur la même période. Celles basées sur le cloud computing pourraient atteindre une croissance de 30 % d’ici 2032, tandis que celles basées sur le traitement du langage naturel atteindraient une valeur de 20 milliards de dollars d’ici la même période.

Alors que ces outils ont été développés dans le but d’appuyer et stimuler le secteur, des préoccupations émergent quant à leur utilisation non conforme à l’éthique. « Tous les cas [d’utilisation] sont potentiellement appropriés ou inappropriés », explique à Trust My Science Daniel Alexander Lee, chercheur post-doctorant à la Faculté des arts, du commerce, de droit et d’économie et de l’École d’éducation de l’Université d’Adelaïde (en Australie). « La question n’est pas de savoir si l’IA est utilisée ou non, mais comment et pourquoi, et si l’utilisation est transparente et modérée », ajoute-t-il en réponse à nos questions.

Des opportunités d’apprentissage adaptatif et personnalisé ?

Les outils d’IA sont utilisés dans le domaine de l’enseignement supérieur et universitaire pour de nombreux aspects, tels que l’évaluation, la prédiction, l’assistance, le tutorat intelligent, etc. Selon Lee, ils sont par exemple intégrés aux programmes éducatifs en tant qu’outils de recherche afin de développer la pensée critique et faciliter le brainstorming. Ils peuvent aussi être utilisés pour la création de notes de cours, pour la traduction, la simulation de laboratoires virtuels, etc. Associée à d’autres technologies, telles que la réalité augmentée ou virtuelle, les outils de traduction et de transcription, l’IA peut fournir des expériences interactives et immersives – des éléments de motivation essentiels pour les étudiants.

Ils sont particulièrement intéressants pour les étudiants lorsqu’ils sont intégrés à des plateformes d’apprentissage personnalisées et interactives. « Les plateformes d’apprentissage adaptatif personnalisent l’expérience d’apprentissage en ajustant le rythme et le style de l’enseignement en fonction des progrès individuels », explique à Trust my Science Helen Crompton, directrice générale de l’Institut de recherche pour l’innovation numérique dans l’apprentissage à ODUGlobal et professeure de technologie pédagogique à l’Université d’Old Dominion (en Virginie, aux États-Unis).

Ils peuvent notamment effectuer des retours d’information rapides par le biais d’un coaching virtuel en temps réel, ce qui permet potentiellement d’améliorer les performances des étudiants. Sans compter que les tuteurs virtuels alimentés par l’IA sont désormais disponibles de manière permanente et pour presque tous les types de besoin en matière d’éducation. Crompton suggère par exemple de demander à une IA d’imiter la personnalité d’un personnage historique, tel que Shakespear, et d’engager un débat sur une thématique. Les élèves peuvent aussi apprendre des langues en demandant à l’outil de leur servir de professeur virtuel.

D’après une récente enquête de Compilatio, 55 % des étudiants utiliseraient actuellement l’IA générative au moins occasionnellement dans le cadre de leurs cours, tandis qu’un étudiant sur deux l’utilise en tant que source de documentation. 63 % des enseignants estiment que l’IA permet aux étudiants d’obtenir de meilleures notes, tandis que près de la moitié (47 %) des étudiants affirment avoir obtenu de meilleures notes grâce à son utilisation.

Un risque de diminution de la pensée autonome et d’augmentation de la malhonnêteté académique

Cependant, l’utilisation intensive de la technologie comporte également des risques. Selon Crompton, « il y a un risque réel que les étudiants deviennent trop dépendants de ces outils. Si les élèves ne sont pas encouragés à penser de manière critique ou à résoudre des problèmes sans aide numérique, nous pourrions constater une diminution de la pensée autonome ». Autrement dit, les processus et les réponses automatisés peuvent freiner la motivation des étudiants à réfléchir par eux-mêmes et à évaluer la fiabilité des sources. Un accès trop facilité à l’information peut entraîner un manque d’effort de mémorisation et de compréhension approfondie.

Des compétences auparavant considérées comme essentielles, telles que la prise de notes, pourraient aussi être perdues, bien que l’IA ne soit pas la seule technologie numérique à y contribuer. Les outils automatisés peuvent en outre limiter la créativité et la capacité de résolution des problèmes, car les solutions sont facilement disponibles. D’autres risques, tels que l’augmentation de la fracture numérique entre les étudiants disposant d’outils de pointe et ceux qui n’en bénéficient pas, sont aussi à considérer.

D’autre part, « il existe un risque de réduction des interactions humaines dans les environnements d’apprentissage, ainsi qu’un impact imprévisible sur les concepts d’éthique », estime Lee. Près de 9 enseignants sur 10 estiment que les étudiants ont recours aux outils IA pour leurs travaux. 76 % des enseignants estiment que cela relève de la triche et est contraire aux principes d’intégrité académique, tandis que seulement 65 % des étudiants rejoignent cet avis. 80 % des enseignants estiment en outre que la plupart de leurs étudiants se contentent de copier-coller des contenus générés par IA pour leurs rendus.

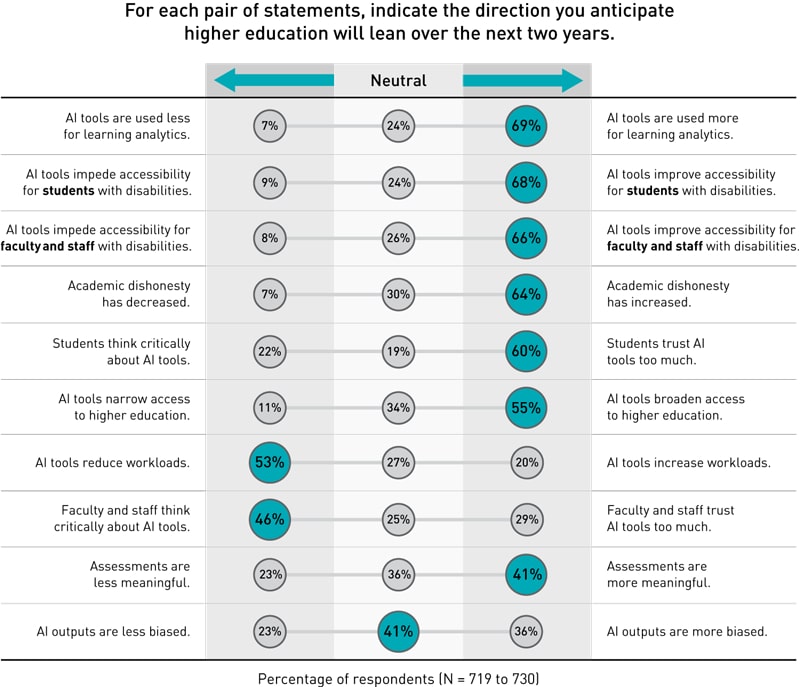

Pour résumer certains chiffres de l’enquête présentée graphiquement ci-dessus (effectuée auprès de plus de 700 enseignants) : 64 % d’entre eux pensent que la malhonnêteté académique augmentera en raison de l’utilisation de l’IA (4e ligne) et 60 % estiment que les étudiants feront excessivement confiance à ces outils (5e ligne), d’ici 2026. « Le risque de trop se fier à la technologie peut avoir une incidence sur la capacité des élèves à s’engager profondément dans les matières », affirme Crompton. De façon ironique, les outils d’IA sont largement utilisés dans les systèmes d’évaluation de l’intégrité académique et dans la détection du plagiat dans les universités, mais leur efficacité est discutable.

Des évaluations automatisées et personnalisées en fonction des étudiants

De leur côté, les professeurs utilisent par exemple des outils d’IA pour la conception et la programmation des cours. De nombreux établissements d’enseignement supérieur utilisent ces outils en les combinant au cloud computing. Cela permet d’optimiser le partage d’informations à travers les campus, surtout pour les réseaux internationaux. « L’IA peut automatiser les tâches administratives de routine et aider les élèves handicapés à accéder plus facilement aux ressources », explique Crompton.

Ils peuvent aussi être utilisés pour automatiser les systèmes de notation et d’évaluation. « L’IA peut concevoir des évaluations adaptatives capables de s’ajuster en fonction des performances des élèves en temps réel », explique Lee. En d’autres termes, les évaluations automatisées par l’IA peuvent ajuster les évaluations en fonction des difficultés que rencontre chaque étudiant, offrant ainsi une mesure précise de leur performance et de leur progression. De nombreuses institutions s’appuient en outre sur des outils d’IA pour l’analyse prédictive de la performance et du taux de réussite des étudiants.

Une récente enquête menée par Lee et ses collègues auprès d’une trentaine d’enseignants d’une grande université australienne indique que près de la moitié d’entre eux utilisent l’IA dans le cadre de leurs fonctions. L’utilisation la plus courante était la conception de systèmes d’évaluation. « Cependant, bien que l’IA puisse aider à évaluer des tests de manière plus objective, les évaluations impliquant la pensée critique ou la créativité nécessitent toujours une supervision humaine pour garantir que les nuances du travail des étudiants sont évaluées équitablement », précise Crompton. « Nous l’utilisons pour générer des questions à choix multiples pour les examens et les questionnaires, mais il existe un processus d’intervention humaine pour maintenir le contrôle de la qualité », ajoute Lee.

Des efforts de réglementation en cours

Malgré les risques d’utilisation abusive, les enseignants ont tout de même le devoir de préparer au mieux les étudiants à l’utilisation des outils d’IA. « L’IA et d’autres technologies sont des outils qui seront utilisés dans le monde professionnel et c’est le rôle de l’enseignement supérieur de préparer les étudiants à ce dernier. Nous devons donc leur apprendre à utiliser ces outils de manière efficace et éthique », affirme Lee.

Afin d’établir un équilibre dans l’utilisation des outils d’IA par les étudiants, les deux experts suggèrent de mettre l’accent sur des compétences qui seront utiles, quels que soient les progrès technologiques, telles que la pensée critique, la littératie numérique, l’adaptabilité, la responsabilisation et la prise de décision éthique. « Équilibrer l’intégration de l’IA dans l’éducation avec des activités qui encouragent la pensée indépendante et la résolution de problèmes peut aider à atténuer ces risques, en favorisant à la fois la maîtrise de la technologie et les compétences d’apprentissage traditionnelles », propose Lee. Les recherches de Lee suggèrent en outre qu’il est essentiel d’apprendre aux étudiants à interagir correctement avec ces outils, par exemple en optimisant les invites de sorte à obtenir de meilleurs résultats.

Des cours sur l’utilisation responsable de l’IA et la sécurité des données seraient aussi essentiels. « Encourager les élèves à comprendre le ‘comment’ et le ‘pourquoi’ de l’IA, plutôt que de se contenter de l’utiliser, favorise un sens des responsabilités et les prépare à un lieu de travail où ils pourraient avoir besoin de travailler aux côtés des systèmes d’IA ou même de superviser ces derniers », indique Crompton. De ce fait, « il est essentiel d’établir des programmes d’études dynamiques et pertinents », ajoute-t-elle.

Près de deux tiers des enseignants et des étudiants partagent le même avis et sont contre l’interdiction de l’IA. Toutefois, 93 % et 79 % (respectivement enseignants et élèves) estiment qu’il faut établir des réglementations pour son utilisation dans l’enseignement. Cependant, l’étude de Lee indique que moins d’un quart du personnel enseignant pense que leur établissement les a correctement équipés en matière d’IA, tandis que plus de trois quarts estiment avoir besoin de davantage de soutien.

D’autre part, une étude de l’UNESCO sur plus de 450 établissements dans le monde indique qu’environ 13 % des universités (contre 7 % pour les établissements scolaires) disposent de mesures d’orientation concernant l’IA, tandis que 20 % des personnes interrogées affirment ne pas savoir si leur établissement applique ou non de telles mesures.

Néanmoins, des efforts dans ce sens sont en cours dans certaines grandes universités. Selon Lee, l’Université du Queensland, l’Université Deakin, l’Université Monash et l’Université de technologie de Sydney intègrent non seulement l’IA dans leurs programmes existants, mais développent également de nouveaux cours et initiatives pour préparer les étudiants à l’évolution du paysage technologique de l’IA.

Le Massachusetts Institute of Technology (MIT), l’Université de Stanford et l’Université Old Dominion, auraient quant à eux mis en place des cours axés sur l’IA et révisé les programmes existants pour intégrer l’éthique de l’IA, la science des données et l’apprentissage automatique. D’autres institutions ont également intégré des programmes interdisciplinaires visant à préparer les étudiants à intégrer l’IA dans divers domaines, tels que la santé et les sciences humaines.

D’autre part, l’Agence australienne pour la qualité et les normes de l’enseignement supérieur (TEQSA) a élaboré des ressources et des lignes directrices pour aider les établissements à intégrer l’IA dans leurs programmes. Cela inclut par exemple des conseils sur l’intégrité académique, l’évaluation et l’utilisation de l’IA générative dans la recherche et l’enseignement. Aux États-Unis, les mesures législatives semblent être adoptées état par état.

En Europe, le projet AI4T (inscrit dans le cadre des projets de soutien à la réforme Erasmus+) vise à former les enseignants à l’IA dans cinq pays différents, y compris la France. Englobant presque tous les aspects de l’application de l’IA, l’AI Act, la réglementation de l’Union européenne récemment entrée en vigueur sur la technologie, couvre également le système éducatif avec des exigences relativement strictes. Les EdTech d’IA à haut risque ne pourront être déployés qu’après une analyse d’impact obligatoire sur les droits humains fondamentaux.

Il y aura inévitablement des changements dans les exigences en matière de compétences à la fois du côté des étudiants et des enseignants, mais quelles que soient les réglementations établies, « il incombe aux éducateurs et aux élèves de s’assurer qu’ils sont utilisés à des fins positives et non pour tricher », conclut Crompton.