Une équipe de chercheurs de Google révèle que l’IA est désormais la principale source de désinformation en ligne basée sur les images. 80 % de la désinformation visuelle sur internet proviendrait notamment des utilisateurs abusifs d’IA. Cette propagation alarmante de fausses informations est due à l’accessibilité et à la popularité des outils génératifs basés sur l’IA et pourrait être hautement préjudiciable pour l’équilibre de la société.

À l’ère des médias sociaux, la propagation de la désinformation devient toujours plus préoccupante. Au cours des dernières années, la croissance explosive de l’utilisation des outils génératifs à base d’IA alimente d’autant plus ces inquiétudes. Bien que des outils d’édition et de création tels que Photoshop puissent, eux aussi, être utilisés à mauvais escient, les contenus générés par IA sont souvent plus réalistes et surtout créés et distribués bien plus facilement.

Cependant, les enquêtes concernant la désinformation en ligne se sont jusqu’à présent principalement concentrées sur les contenus textuels. Les contenus d’images n’ont reçu que relativement peu d’attention, ce qui est étonnant en vue de la forte utilisation des plateformes de médias en ligne telles que YouTube et Tik Tok. Ces plateformes comptent chacune plus d’un milliard d’utilisateurs et plus de 3,5 milliards d’images y sont partagées quotidiennement au total.

D’un autre côté, les images sont généralement considérées comme des moyens de communication persuasifs et efficaces. Des études ont montré que celles véhiculant des revendications sont en général perçues comme pertinentes et peuvent modifier la perception quant à l’exactitude de cette revendication. De ce fait, il ne serait pas surprenant que la désinformation visuelle grimpe en flèche parallèlement à la propagation d’images générées par IA.

La nouvelle étude, codirigée par des chercheurs de Google, est l’une des rares à évaluer l’ampleur de la propagation de la désinformation visuelle générée par IA. « La prévalence et les méfaits de la désinformation en ligne constituent une préoccupation constante pour internet, les institutions et la société dans son ensemble », expliquent-ils dans leur rapport, prépublié sur la plateforme arXiv. « La montée en puissance des outils génératifs basés sur l’IA, qui fournissent des méthodes largement accessibles pour synthétiser de l’audio, des images, des vidéos et des textes réalistes, ont amplifié ces préoccupations », ont-ils écrit.

80 % de la désinformation à base d’images est désormais générée par l’IA

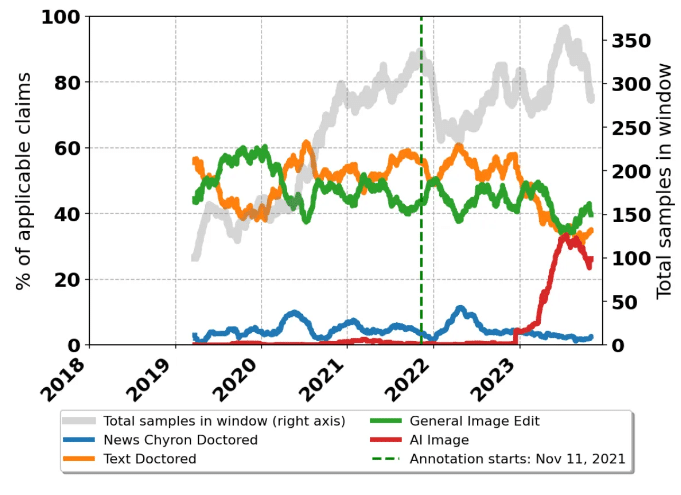

Dans le cadre de son enquête, l’équipe de recherche a analysé 135 838 éléments de médias en ligne principalement basés sur des images. Leur exactitude a été vérifiée par 83 évaluateurs utilisant ClaimReview, un système de balisage que les éditeurs utilisent pour vérifier les informations pour les moteurs de recherche, les applications et les plateformes de réseaux sociaux, tels que Google, Bing et Facebook.

Les chercheurs ont constaté que les contenus générés par IA représentaient 80 % de la désinformation à base d’images au moment de l’enquête. D’autre part, « l’essor du contenu génératif basé sur l’IA dans les allégations de désinformation et son caractère commun est un phénomène relativement récent, survenant de manière significative après une forte couverture médiatique », ont-ils écrit. En outre, les méthodes utilisées pour la propagation des fausses informations sont principalement basées sur la manipulation de contextes.

Ce taux est préoccupant, surtout pour les contenus politiquement sensibles tels que ceux concernant les élections ou les conflits. Les « deepfakes » de personnalités pourraient par exemple modifier la perception des gens quant à certains candidats politiques et influencer leur vote — ce qui pourrait avoir des impacts majeurs sur l’ensemble du pays. Vers la fin de l’année dernière, une propagation alarmante de fausses images générées par IA concernant la guerre Israël-Hamas a notamment été rapportée.

Parallèlement, les résultats des moteurs de recherche comme Google Search baissent considérablement en qualité à mesure que les contenus générés par IA se propagent. Alors que le géant de la tech se positionne parmi les principaux acteurs de la course à l’IA, son moteur de recherche se dégrade en raison de l’augmentation de contenus médiocres générés par IA.

Toutefois, il est important de noter que la capacité de vérification de ClaimReview n’est pas infaillible, ont précisé les chercheurs. « La capacité de vérification des faits n’est pas complètement élastique, et nous ne pouvons pas supposer qu’elle évoluera nécessairement avec le volume global de désinformation », a expliqué Nicholas Dufour de Google, auteur principal de l’étude, à 404 Media. De plus, l’enquête n’a pas inclus l’utilisation partielle de l’IA dans la génération de contenus. Néanmoins, ces résultats soulignent déjà l’ampleur de la propagation de la désinformation et devraient servir de lanceurs d’alerte pour le public et les décideurs politiques.