Des chercheurs ont mis au point des réseaux de neurones artificiels dits « infomorphes », capables d’apprendre de manière autonome et auto-organisée à partir de leur environnement immédiat. En s’affranchissant d’un contrôle externe, ces systèmes se rapprochent ainsi du fonctionnement des réseaux neuronaux biologiques (comme le cerveau), marquant une avancée très prometteuse dans le domaine de l’apprentissage automatique.

Les réseaux de neurones, qu’ils soient biologiques ou artificiels, tirent leur efficacité de leur structure en réseau dense, composée d’une multitude d’unités de calcul interconnectées. Chez l’humain, le néocortex repose sur une diversité de types neuronaux agencés en microcircuits répétitifs, conférant une remarquable plasticité fonctionnelle. Les réseaux artificiels s’inspirent de cette organisation, en misant sur la répétitivité d’unités de traitement simples, ce qui leur permet de croître en taille et en complexité.

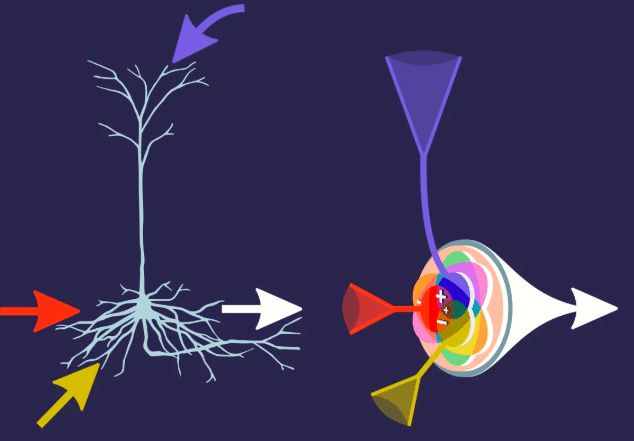

Schématiquement, chaque neurone agit comme une unité de calcul simplifiée. Dans les architectures artificielles, les neurones sont organisés en couches successives, au travers desquelles circulent les signaux d’entrée. Ces signaux sont traités afin d’en extraire des informations jugées pertinentes.

Mais une différence fondamentale subsiste : les réseaux biologiques n’apprennent pas comme leurs homologues artificiels. Tandis que ces derniers dépendent souvent d’une coordination centralisée et externe, les neurones biologiques s’appuient sur les signaux locaux émis par leurs voisins immédiats. Ce mode d’apprentissage distribué confère aux réseaux naturels une flexibilité et une efficacité énergétique bien supérieures à celles des modèles artificiels traditionnels.

Dans l’objectif de rapprocher les réseaux artificiels de leurs équivalents biologiques, des chercheurs de l’Institut de dynamique des réseaux biologiques (CIDBN) de l’Université de Göttingen et de l’Institut Max Planck de dynamique et d’auto-organisation (MPI-DS) ont conçu des réseaux fondés sur des neurones dits infomorphes. Leurs travaux sont publiés dans la revue PNAS, ainsi qu’en prépublication sur la plateforme arXiv.

« Dans les réseaux neuronaux profonds actuels, la dynamique d’apprentissage des neurones individuels reste souvent opaque, car pilotée par une optimisation globale. Les systèmes biologiques, eux, misent sur un apprentissage local, auto-organisé, qui garantit robustesse et efficacité malgré une information globale limitée », écrivent les auteurs dans leur document. « Nous démontrons ici comment une telle auto-organisation peut émerger entre neurones artificiels, en définissant des objectifs d’apprentissage locaux, abstraits et inspirés du vivant ».

Des objectifs d’apprentissage clairs et universels

La méthode développée par les chercheurs repose sur un cadre théorique baptisé « décomposition partielle de l’information » (DPI), une traduction usuelle de *Partial Information Decomposition* (PID), qui prolonge les fondements de la théorie de l’information. Ce cadre permet de répartir l’information transmise par un ensemble de sources en composantes uniques, redondantes ou synergiques. Ainsi, les neurones infomorphes intègrent localement l’information issue de diverses entrées, en sélectionnant celles dont les signaux sont conjoints ou redondants. Ce traitement distribué autorise un apprentissage spontané à partir des interactions avec l’environnement immédiat.

« En rendant l’apprentissage interprétable à l’échelle du neurone tout en assurant des performances robustes via un apprentissage local, notre travail jette les bases d’une théorie de l’apprentissage fondée sur l’information », affirment les auteurs. Pour concevoir ces neurones infomorphes, l’équipe s’est inspirée du fonctionnement des cellules pyramidales du cortex cérébral, réputées pour leur capacité à traiter les signaux contextuels de façon adaptative.

Les neurones artificiels développés dans ce cadre suivent des objectifs d’apprentissage simples, généraux, mais puissants. « Nous comprenons désormais clairement le fonctionnement interne du réseau, et la manière dont chaque neurone apprend de manière indépendante », souligne Marcel Graetz du CIDBN, coauteur de l’étude, dans un communiqué de l’Institut Max Planck.

Après avoir défini leurs propres objectifs d’apprentissage, ces neurones établissent ensuite des règles d’apprentissage spécifiques. En se concentrant sur leur propre processus cognitif, les chercheurs ont appliqué une nouvelle métrique issue de la théorie de l’information afin de déterminer si un neurone devait rechercher des signaux répétitifs, collaborer de manière synergique avec ses pairs ou se spécialiser dans une composante de l’information globale.

« En se spécialisant dans certains aspects de l’entrée et en se coordonnant avec leurs voisins, nos neurones infomorphes contribuent collectivement à la tâche assignée au réseau », conclut Valentin Neuhaus, coauteur de l’étude au sein du MPI-DS. Ce nouveau type de neurone pourrait aboutir au développement d’une intelligence artificielle plus autonome, tout en approfondissant notre compréhension des mécanismes d’apprentissage cérébral.