Certaines théories neuroscientifiques suggèrent que le cerveau humain fonctionne mieux lorsqu’il se trouve dans un état que l’on désigne par « la frontière du chaos ». De la même manière, une équipe de chercheurs démontre aujourd’hui que le fait de maintenir un réseau artificiel de nanofils dans cet état particulier fournit les meilleurs résultats : il serait alors capable de réagir comme un vrai cerveau humain.

La frontière du chaos est un espace de transition entre l’ordre et le désordre, qui existerait dans une grande variété de systèmes, y compris le cerveau humain. Certains neuroscientifiques pensent ainsi que l’esprit humain pourrait non seulement fonctionner dans cet état critique, mais pourrait même atteindre le maximum de ses performances cérébrales une fois plongé dans cet état particulier.

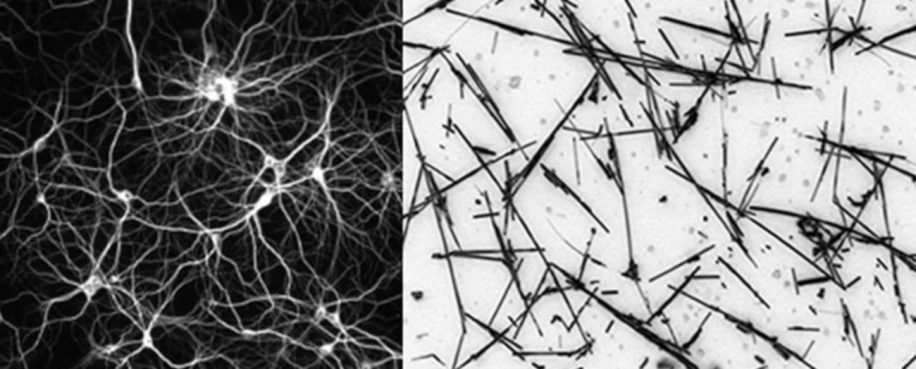

Partant de ce principe, des scientifiques de l’Université de Sydney et de l’Institut national japonais des sciences des matériaux ont découvert qu’un réseau artificiel de nanofils pouvait effectuer une tâche de façon optimale lorsqu’il était stimulé de manière à se trouver au bord de l’état chaotique. Les résultats de leur étude, publiée dans Nature Communications, suggèrent ainsi que la nature sous-jacente de l’intelligence neuronale est physique, ce qui ouvre une nouvelle voie passionnante pour le développement de l’intelligence artificielle.

Des performances optimales obtenues au bord du chaos

Pour leurs expérimentations, les chercheurs ont utilisé un réseau de fils de 10 micromètres de long et pas plus de 500 nanomètres d’épaisseur ; les fils étaient disposés de manière aléatoire sur un plan bidimensionnel. « Là où les fils se chevauchent, ils forment une jonction électrochimique, comme les synapses entre les neurones », explique Joel Hochstetter, doctorant à l’Université de Sydney et auteur principal de l’étude.

L’équipe a alors découvert que les signaux électriques transmis par ce réseau trouvaient automatiquement le meilleur itinéraire pour transmettre des informations. En outre, cette architecture permet au réseau de « se souvenir » des chemins précédents à travers le système. « Ces jonctions agissent comme des transistors informatiques, mais avec la propriété supplémentaire de se rappeler que les signaux ont déjà parcouru cette voie auparavant », souligne Hochstetter.

Pour parvenir à cette conclusion, l’équipe a testé ce réseau de nanofils de manière à déterminer, par stimulation électrique, comment le rendre plus performant dans la résolution de tâches simples ; le réseau était chargé ici de transformer une forme d’onde simple en types de formes d’onde plus complexes. Les chercheurs ont fait varier l’amplitude et la fréquence du signal électrique pour voir où se trouvaient les meilleures performances. Lorsque le signal stimulant le réseau était trop faible, alors les voies étaient trop prévisibles et ordonnées et ne produisaient pas des sorties suffisamment complexes pour être utiles. « Si vous poussez le signal trop lentement, le réseau fait la même chose encore et encore, sans apprendre ni développer », résume Hochstetter.

De même, lorsque le signal électrique submergeait le réseau, la sortie était complètement chaotique et inutile pour la résolution de problèmes. Par conséquent, le signal jugé optimal pour produire une sortie utile se trouvait entre ces deux extrêmes, autrement dit, au bord de l’état chaotique. Cette découverte suggère que ces types de réseaux de nanofils peuvent être réglés de manière à adopter diverses dynamiques collectives, semblables à celles observées dans le cerveau humain, qui peuvent potentiellement être exploitées pour optimiser le traitement de l’information.

Mémoire et opérations réunis dans un seul système

Au contraire des ordinateurs conventionnels, dans lesquels la mémoire et le traitement sont clairement séparés (RAM d’un côté, CPU de l’autre), les réseaux de nanofils combinent les deux systèmes en un seul : ils peuvent se souvenir des signaux précédents, et ainsi modifier leur sortie future en fonction de ce qui s’est produit auparavant. Hochstetter précise qu’en tant que tels, ils sont appelés « memristors ».

La mémoire prend ici une forme physique, où les jonctions aux points de croisement entre les nanofils agissent comme des interrupteurs, dont le comportement dépend de la réponse historique aux signaux électriques. Lorsque des signaux sont appliqués à travers ces jonctions, de minuscules filaments d’argent se développent, activant les jonctions permettant au courant de circuler. « Cela crée un réseau de mémoire au sein du système aléatoire de nanofils », explique Hochstetter.

Pour le professeur Zdenka Kuncic, qui supervise le travail d’Hochstetter à l’Université de Sydney, cette union de la mémoire et des opérations présente d’énormes avantages pratiques pour le développement futur de l’intelligence artificielle. « Les algorithmes nécessaires pour entraîner le réseau à déterminer à quelle jonction devrait être accordé la charge ou le poids d’informations approprié consomment beaucoup de puissance », explique-t-elle.

Or, la capacité de mémoire de ce type de réseau implique une consommation d’énergie considérablement réduite, car les réseaux finissent par s’entraîner eux-mêmes en utilisant les processus les plus efficaces ; ils développent leur propre pondération. À mesure que les réseaux d’intelligence artificielle se développeront, il sera important de pouvoir les garder légers et aussi peu gourmands que possible. « Tout futur système d’intelligence artificielle utilisant de tels réseaux aurait une empreinte énergétique beaucoup plus faible », conclut Kuncic.