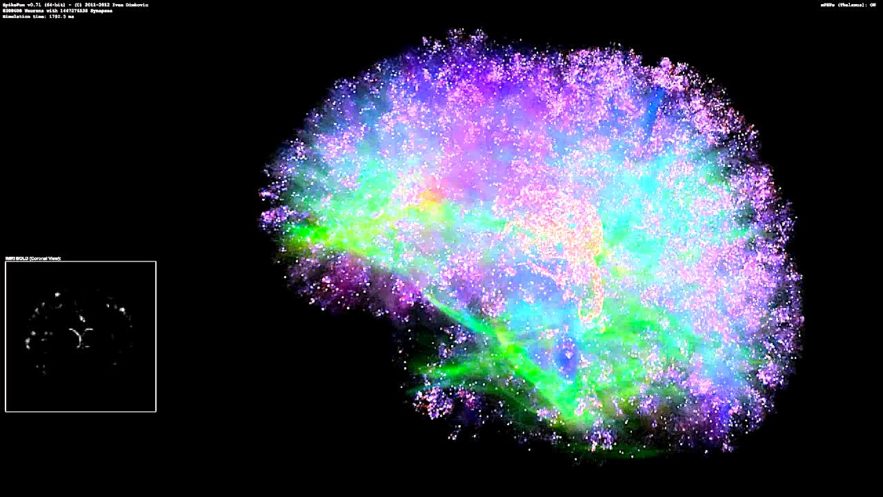

Des chercheurs en ingénierie informatique ont créé la simulation la plus rapide et la plus économe en énergie d’une partie du cerveau d’un rat, à l’aide de matériel informatique de nouvelle génération optimisé notamment pour l’IA.

Le docteur James Knight et le professeur Thomas Nowotny de la faculté d’ingénierie et d’informatique de l’Université du Sussex (Royaume-Uni), ont littéralement fait mieux que l’un des supercalculateurs du top 50 en effectuant des simulations cérébrales. Ils ont utilisé leur propre logiciel, nommé GeNN (GPU-enhanced Neuronal Networks), ainsi que des unités de traitement graphique (GPU).

En développant des simulateurs plus rapides et plus efficaces, les chercheurs espèrent accroître la compréhension du fonctionnement du cerveau et, en particulier, déterminer comment les dommages causés à certaines structures neuronales peuvent entraîner des déficits de la fonction cérébrale. De plus, des simulateurs plus rapides et plus avancés pourraient aider à améliorer la compréhension des troubles neurologiques, en localisant les zones du cerveau responsables des crises d’épilepsie. L’étude a été publiée dans la revue Frontiers in Neuroscience.

Il ne faut pas oublier non plus les retombées pour l’intelligence artificielle. En effet, de tels simulateurs améliorés pourraient également accélérer les progrès dans le développement d’intelligences artificielles — le logiciel GeNN est déjà utilisé à l’Université de Sussex pour la mise au point de robots autonomes, notamment des drones pouvant être contrôlés au moyen de simulations de cerveaux d’insectes.

Nowotny, professeur d’informatique à l’Université du Sussex, a expliqué qu’au cours des trois dernières décennies, les ordinateurs sont devenus considérablement plus puissants, en grande partie grâce à notre capacité à fabriquer des puces informatiques avec des composants de plus en plus petits, ce qui leur permet de devenir de plus en plus rapides.

« Mais ce processus a atteint un palier, et il est devenu beaucoup plus difficile de concevoir des ordinateurs plus rapides sans utiliser des architectures radicalement différentes. Les GPU en sont une, et notre travail montre qu’à court terme, ils constituent une solution compétitive pour le calcul haute performance. Les GPU ont le potentiel de permettre des progrès allant bien au-delà de ce que les processeurs nous ont permis jusqu’à présent » explique Nowotny.

L’étude réalisée a consisté à utiliser le logiciel GeNN, conçu par l’équipe, pour mettre en œuvre et tester deux modèles de neuroscience informatique bien établis ; un microcircuit cortical constitué de huit populations de neurones, et un réseau aléatoire équilibré avec une plasticité dépendant du pic de synchronisation — un processus qui s’est avéré fondamental pour l’apprentissage biologique.

Un seul processeur graphique a permis d’atteindre des vitesses de traitement jusqu’à 10% plus rapides que ce qui est actuellement possible en utilisant un superordinateur ou le système neuromorphique SpiNNaker, une machine sur mesure développée dans le cadre du projet européen Human Brain (HBP).

L’équipe de l’Université de Sussex a également pu réaliser des économies d’énergie 10 fois supérieures à celles obtenues lors de simulations réalisées avec SpiNNaker, ou avec des supercalculateurs.

Pour aller de l’avant, les scientifiques pensent que la flexibilité et la puissance des GPU devraient être exploités au maximum, car elles jouent un rôle clé dans la création de simulateurs capables de gérer des modèles s’approchant de la complexité du cerveau humain.

Le Dr Knight a déclaré : « Bien que nous soyons loin d’avoir la compréhension nécessaire pour construire des modèles de cerveau humain complets, nous approchons du point où les supercalculateurs exascale de dernière génération auraient la puissance de calcul brute nécessaire pour les simuler. Étant donné que nombre de ces systèmes reposent sur des GPU, nous sommes ravis de ces derniers résultats, qui montrent à quel point les GPU sont bien adaptés à la simulation cérébrale. Nous espérons étendre notre travail sur un modèle 50 fois plus grand que celui d’un système visuel de singe, en utilisant plusieurs GPU interconnectés ».

Chris Emerson, responsable des ventes pour l’enseignement supérieur et la recherche au Royaume-Uni et en Irlande chez NVIDIA, a déclaré : « Nous sommes très impressionnés par l’utilisation de la plate-forme de calcul NVIDIA AI pour les simulations cérébrales faites par l’Université du Sussex. Nous sommes fiers de soutenir la recherche à la pointe de la neuroscience informatique ainsi que de l’intelligence artificielle ».