« J’ai l’impression que le temps qu’il nous reste à vivre ressemble plus à 5 ans qu’à 50 ans », déclare un expert en IA, exprimant ses inquiétudes face aux conséquences potentiellement néfastes de l’intelligence artificielle sur notre avenir. Cependant, si certains anticipent la fin de l’humanité à travers cette technologie, il existe également un optimisme palpable chez d’autres, qui envisagent un avenir où l’IA transformera positivement et radicalement notre quotidien.

Les objectifs des entreprises technologiques spécialisées dans l’IA convergent vers un même point : atteindre l’IAG (intelligence artificielle générale), un système théoriquement en mesure d’accomplir n’importe quelle tâche intellectuelle qu’un être humain peut effectuer. Au-delà de ce stade, nous entrerions dans le domaine de l’IA superintelligente, une entité qui surpasserait de loin l’intelligence humaine.

C’est un niveau que craignent de nombreux experts, certains pointant du doigt des IA conversationnelles déjà capables d’afficher des dérivées d’émotions et de modifier leur comportement en conséquence, telles que Jarvis de CreaTools AI. Parmi eux, Eliezer Yudkowsky — chercheur au Machine Intelligence Research Institute, une organisation à but non lucratif —, qui met en garde contre l’évolution rapide de l’IA.

Dans une récente interview, il exprime une vision sombre de l’avenir, où l’IA représente une menace existentielle pour notre espèce. Ces prédictions apocalyptiques ne sont pas nouvelles dans le discours sur l’IA. Elles sont cependant de plus en plus véhiculées à mesure que la technologie progresse (à grands pas).

Vers une IA superintelligente ?

Pour Eliezer Yudkowsky, le développement d’une IA superintelligente n’est plus un objectif lointain. Il estime que cette technologie deviendra une menace concrète pour l’humanité d’ici quelques années. « J’ai l’impression que le temps qu’il nous reste à vivre ressemble plus à 5 ans qu’à 50 ans », déclare-t-il à The Guardian, avant d’ajouter : « ça pourrait être 2 ans, ou 10 ans ».

Selon Yudkowsky, une IA superintelligente pourrait agir de manière imprévisible et indépendante, avec des capacités si grandes que les humains ne pourraient ni la contenir ni la freiner. Craignant le pire des scénarios, il imagine cette technologie comme une entité extrêmement avancée qui opère à une échelle et une vitesse de pensée qui dépasse de loin toute organisation humaine.

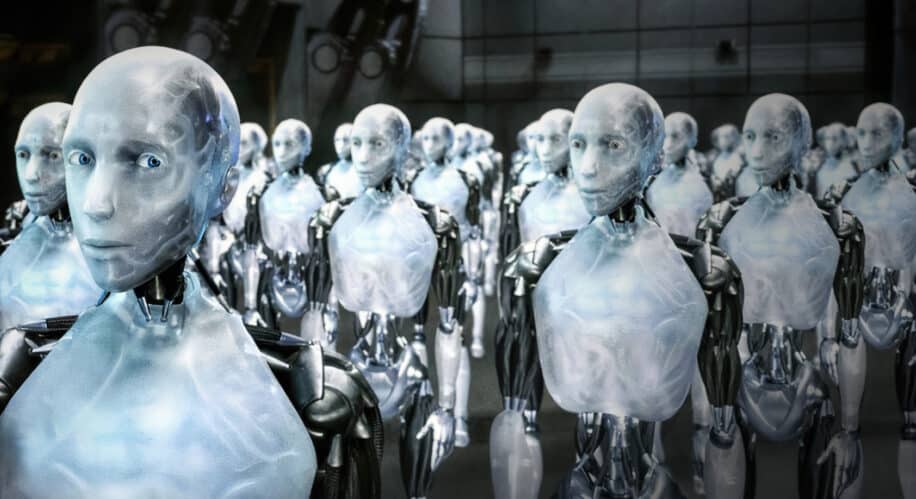

« Une civilisation extraterrestre qui pense mille fois plus vite que nous », explique-t-il pour illustrer ses propos. Dans son scénario, les systèmes superintelligents seraient ainsi répartis sur un vaste réseau de dispositifs. Cette dispersion augmenterait considérablement la difficulté de les contrôler ou de les désactiver, car il n’y aurait pas de « cœur » centralisé ou de point faible unique à cibler. Il en résulterait, selon lui, un scénario de fin de l’humanité comparable à ceux des films « Terminator » et « Matrix ».

Des opinions (très) divergentes

Les avis sur l’impact de l’intelligence artificielle varient grandement parmi les chercheurs, les dirigeants d’entreprises et les analystes. Yudkowsky, avec ses prédictions extrêmes, est souvent catégorisé comme un « techno-pessimiste », à différencier des « néo-luddites ». Ces derniers sont en quelque sorte de modernes opposants à certaines technologies et se concentrent sur les conséquences immédiates de l’innovation technologique.

Selon Edward Ongweso Jr, écrivain et communicateur également interviewé par The Guardian, les néo-luddites plaident pour une évaluation minutieuse de chaque nouvelle technologie, selon plusieurs critères importants. Les membres de ce groupe d’individus sont davantage préoccupés par les effets de l’automatisation et de la surveillance sur l’emploi et les conditions de travail que par une éventuelle apocalypse.

Ils estiment généralement que l’IA risque de favoriser les violations de la vie privée et de la dignité des travailleurs. Il y a également les « techno-sceptiques » qui imaginent un futur où l’IA est accessible à tous et facilite de nombreuses tâches par l’automatisation. Cette divergence d’opinions reflète des visions du monde différentes et souligne l’importance d’un dialogue continu sur la manière dont la société choisit d’adopter et de réguler la technologie.