Phénomène technologique émergent de plus en plus important dans la société humaine, l’intelligence artificielle (IA) a révolutionné un grand nombre de domaines, de la médecine à l’économie en passant par l’armée et la circulation routière. Mais elle joue également un rôle crucial en science, où elle s’impose aujourd’hui comme un outil indispensable aux scientifiques.

L’intelligence artificielle, sous toutes ses formes, s’est propagée dans de très nombreux secteurs scientifiques, jusqu’à devenir une ressource inestimable pour les chercheurs. Dotée d’un énorme potentiel calculatoir et prédictif, l’IA constitue aujourd’hui le principal outil de recherche dans un grand nombre de laboratoires et d’institutions scientifiques. De la détection d’exoplanètes au diagnostic de pathologies complexes, les cerveaux numériques ne cessent de briller par leurs prouesses.

L’intelligence artificielles et la chasse aux nouvelles particules

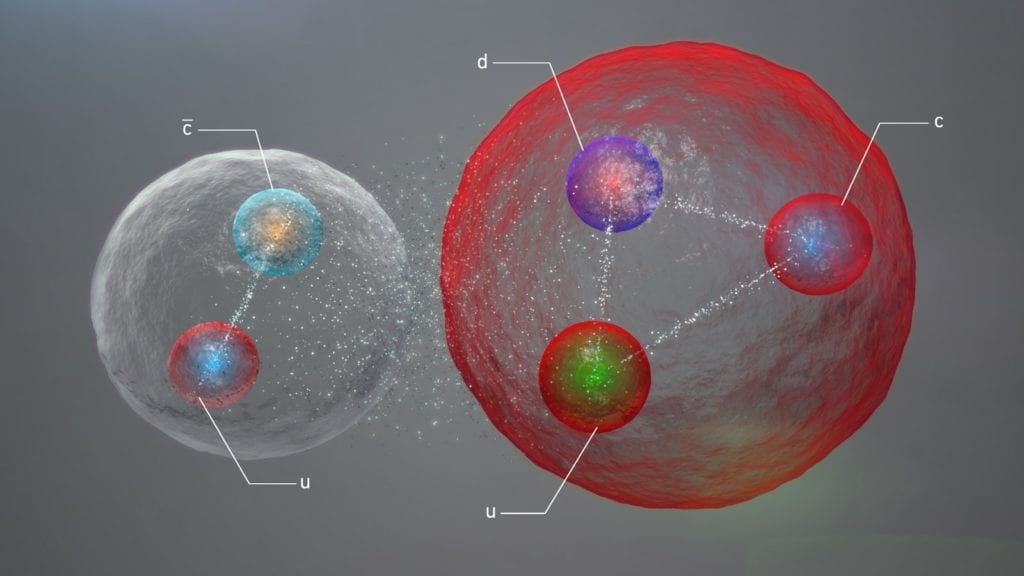

La recherche de nouvelles particules est l’objectif principal des accélérateurs de particules, et constitue un domaine extrêmement actif de la physique théorique et expérimentale. Les physiciens impliquent les premiers modèles d’IA dans cette traque aux particules dès la fin des années 1980, via l’utilisation d’algorithmes de machine-learning (apprentissage automatique) servant de base aux réseaux de neurones artificiels.

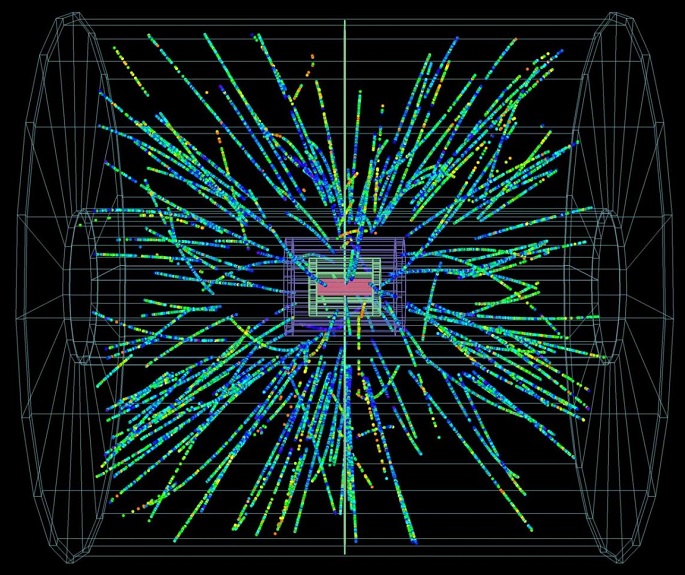

Les millions de collisions au sein des accélérateurs de particules donnent lieu à l’enregistrement d’un très grand nombre de données, qui doivent ensuite être minutieusement étudiées. Cette activité d’analyse constitue la partie la plus importante du travail des physiciens, qui s’astreignent à identifier des schémas et des récurrences subtiles dans les produits de collision, dans le but de mettre en évidence de nouvelles signatures énergétiques.

C’est ce travail qui a permis aux scientifiques du LHC (Cern) d’identifier le boson de Higgs, en observant une gamme d’énergie correspondante aux prédictions théoriques et aux simulations.

Les signatures de ces particules sont rarement aisément identifiables et se trouvent généralement noyées dans le bruit de fond et l’énergie des produits de désintégration. Par exemple, au LHC, un boson de Higgs est produit tous les milliards de collisions proton-proton et, en un milliardième de picoseconde, se désintègre en d’autres particules telles que les photons et les muons. Par suite, les physiciens doivent reconstruire le schéma menant au boson de Higgs, en identifiant de manière cohérente chaque particule impliquée dans le phénomène.

C’est là que les réseaux de neurones entrent en scène. Au sein d’un détecteur de particules, les particules comme les photons, les électrons ou les hadrons sont à l’origine d’une cascade de sous-particules se déversant dans un calorimètre électronique. Cette cascade de sous-particules diffère très subtilement selon la particule qui en est à l’origine. Les algorithmes de machine-learning disposent d’une telle capacité d’analyse et de discrimination qu’ils sont capables d’identifier précisément la source de la cascade, et discriminer si une paire de photons provient de la désintégration d’un boson de Higgs ou non.

Bien qu’extrêmement utile, l’IA n’a cependant pas remplacé les physiciens, qui continuent de s’appuyer majoritairement sur leur compréhension des modèles théoriques pour identifier des anomalies dans les spectres des particules. Mais l’IA s’imposera de plus en plus selon Paolo Calafiura, analyste au Berkeley National Laboratory (Californie). En 2024, les scientifiques souhaitent multiplier le nombre de collisions par 10 au LHC ; à ce moment-là, l’IA deviendra vitale.

Quand l’intelligence artificielle analyse et prédit le comportement des populations

L’avènement des réseaux sociaux a ouvert la voie à l’échange de plusieurs centaines de millions de communications quotidiennes. De telles quantités de données, par ailleurs aisément accessibles, ont fourni aux scientifiques la possibilité d’employer l’intelligence artificielle afin d’étudier ces communications et d’en tirer des conclusions, selon le psychologue Martin Seligman.

Au Centre de Psychologie Positive de Pennsylvanie, Seligman et plus de 20 psychologues, médecins, et data scientists impliqués dans le World Well-Being Project utilisent les réseaux de neurones et les algorithmes de langage naturel pour analyser ces données et jauger la santé physique et mentale des populations.

Ce genre d’analyse est généralement réalisé au moyen d’enquêtes et de questionnaires. Mais le nombre croissant de données disponibles directement à partir des communications — ainsi que la facilité d’accès et le faible coût du processus — offre aux scientifiques le moyen de combiner d’énormes quantités de données en peu de temps. Bien qu’une telle agglomération de données se révèle souvent chaotique, l’IA constitue un puissant outil de discrimination pour révéler des schémas comportementaux individuels ou collectifs.

Dans une étude récente, Seligman et ses collègues ont étudié 29’000 publications d’utilisateurs de Facebook, avouant un état global de dépression. En utilisant les données de 28’000 d’entre eux, un réseau de neurones a identifié une correspondance entre les mots utilisés dans les publication et la sévérité de la dépression. Il a ensuite réussi avec succès à déterminer la sévérité de la dépression d’autres utilisateurs en se basant uniquement sur les mots employés.

Dans une autre étude, l’algorithme a correctement prédit le taux de… (suite à la page suivante)

L’électron est une particule élémentaire qui, avec les protons et les neutrons, constitue les atomes. C’est donc l’un des composants principaux de la matière baryonique. À ce titre, il revêt... [...]

L’électron est une particule élémentaire qui, avec les protons et les neutrons, constitue les atomes. C’est donc l’un des composants principaux de la matière baryonique. À ce titre, il revêt... [...]