L’intelligence artificielle a pour but d’imiter les capacités cognitives d’un être humain, jusqu’à peut-être espérer y inclure un jour une notion considérée comme propre à l’Homme ou du moins aux espèces animales les plus évoluées : la conscience. Encore difficile à définir, la conscience divise la communauté scientifique quant à la possibilité de l’intégrer aux machines. En effet, « artificiel » et « conscience » constitue un fort paradoxe, impossible à réconcilier pour certains. Où en est-on sur les avancées technologiques en la matière ?

D’emblée, la problématique posée s’accompagne de la question fondamentale de la définition de la conscience. Elle signifie littéralement « savoir (scientia) avec (cum) », ce qui suggère l’idée d’un accompagnement, une connaissance qui est avec soi et qui serait donc le propre de l’Homme. La conscience serait la capacité de se séparer de soi-même pour se « représenter » soi-même, et serait accompagnée d’un corps et d’une morale, ce qui tend à exclure les robots et autres intelligences artificielles de sa possible acquisition.

Le fameux « Je pense donc je suis » de Descartes semble d’ailleurs suivre ce même principe anthropocentré. En réalité, la définition de la conscience reste imprécise et il s’agit selon André Comte-Sponville de « l’un des mots les plus difficiles à définir ». Une conscience qui tente de s’autodéfinir pose ainsi problème à certains experts.

Alan Turing et John von Neumann (les fondateurs de la science moderne du calcul) ont envisagé la possibilité que les machines finissent par imiter toutes les capacités du cerveau, y compris la conscience. Daniel Dennett, de l’université Tufts (Massachusetts), considère que le test de Turing suffit à prouver cette possibilité, s’il est réalisé « avec la vigueur, l’agressivité et l’intelligence appropriées ». Pour rappel, dans le test de Turing, une machine doit convaincre un interrogateur humain qu’elle est consciente.

« Les machines actuelles mettent encore principalement en œuvre des calculs qui reflètent un traitement inconscient dans le cerveau humain »

Pour savoir si les machines pourront un jour être dotées de conscience, il s’agit d’abord d’examiner la manière dont elle apparaît dans le cerveau humain. L’année dernière, trois neuroscientifiques se sont penchés sur le sujet en suggérant que le mot « conscience » regroupe deux types différents de calculs de traitement de l’information dans le cerveau : la sélection de l’information pour une diffusion globale, la rendant ainsi disponible de manière flexible pour le calcul et le rapport (C1, conscience dans le premier sens), et l’autocontrôle de ces calculs, qui mène à un sentiment subjectif de certitude ou d’erreur (C2, conscience dans le second sens).

C1 correspond au sens transitif de conscience et fait référence à la relation entre un système cognitif et un objet spécifique de la pensée, par exemple une représentation mentale de « la lumière ». L’information consciente est toujours présente, disponible pour plus tard. Le niveau de conscience C2 va encore plus loin, puisqu’il s’agit d’un autocontrôle, une conscience réflexive propre à l’humain. « Le système cognitif est capable de surveiller ses propres processus et d’obtenir des informations sur lui-même », écrivent les auteurs. « Les êtres humains savent beaucoup de choses sur eux-mêmes, y compris des informations aussi diverses que la disposition et la position de leur corps, s’ils savent ou perçoivent quelque chose, ou s’ils viennent de commettre une erreur. Ce sentiment de conscience correspond à ce que l’on appelle communément l’introspection, ou ce que les psychologues appellent la ‘métacognition’, c’est-à-dire la capacité de concevoir et d’utiliser des représentations internes de ses propres connaissances et capacités ».

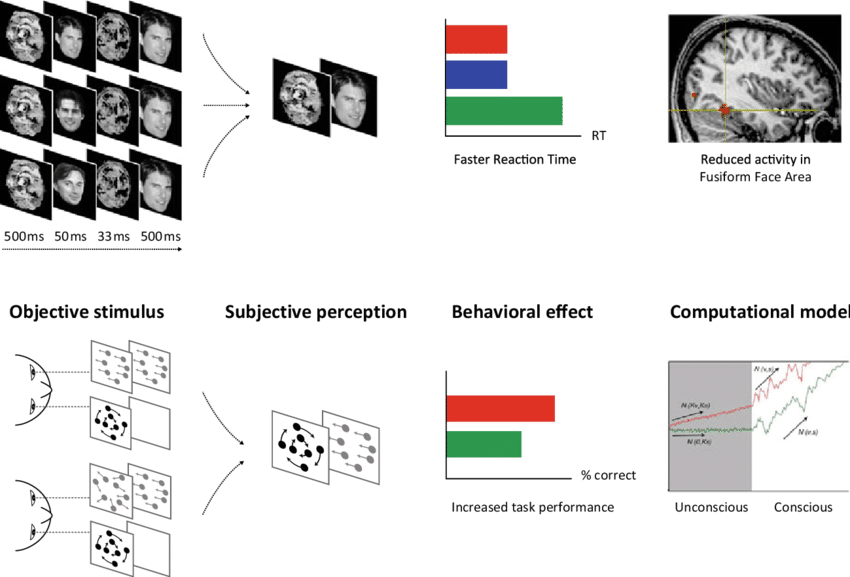

Les chercheurs en neurosciences cognitives ont alors mis au point divers moyens de présenter des images ou des sons sans induire d’expérience consciente, puis ont utilisé l’imagerie comportementale et cérébrale pour sonder la profondeur de leur traitement. Les méthodes de neuro-imagerie révèlent que la grande majorité des zones du cerveau peuvent être activées de manière non consciente, par exemple pendant la reconnaissance invariante de visages. Ainsi, le traitement du visage d’une personne est facilité lorsqu’il est précédé par la présentation subliminale d’une vue totalement différente de la même personne, ce qui indique une reconnaissance invariante inconsciente (niveau C0).

En fait, le système conscient (C1+C2) serait nécessaire pour constituer une intelligence artificielle « forte » : autoapprenante, capable de traiter tout travail intellectuel et autoévaluatrice. Au contraire, d’après les neuroscientifiques, la plupart des systèmes actuels d’apprentissage automatique sont dépourvus d’autocontrôle : ils calculent sans tenir compte de l’étendue et des limites de leurs connaissances, ou du fait que d’autres peuvent avoir un point de vue différent du leur. « Nous soutenons qu’en dépit de leurs récents succès, les machines actuelles mettent encore principalement en œuvre des calculs qui reflètent un traitement inconscient (C0) dans le cerveau humain », concluent les trois chercheurs.

À ce jour, la majorité des scientifiques s’accordent à dire qu’il existe une intelligence artificielle « faible » et que répondre à la problématique par l’affirmative implique tout simplement une autre forme de conscience.

Avancées de l’intelligence artificielle : une forme de conscience différente

Toutefois, même s’il existe encore un fossé entre le fonctionnement de notre cerveau et celui d’un algorithme, force est de constater que les perfectionnements de l’apprentissage automatique (inspirés de la neurobiologie) ont conduit à des réseaux neuronaux artificiels qui surpassent parfois l’humain. Les progrès réalisés dans le domaine du matériel informatique et des algorithmes d’apprentissage permettent aujourd’hui à ces réseaux de traiter des problèmes complexes (par exemple, la traduction automatique) avec de très bons taux de réussite. Seraient-ils à l’aube de la conscience ?

« La conscience artificielle peut progresser en étudiant les architectures qui permettent au cerveau humain de générer la conscience, puis en transférant ces connaissances dans des algorithmes informatiques », continuent les trois chercheurs. Ainsi, certains aspects de la cognition et des neurosciences de la conscience peuvent simplement être pertinents pour les machines, sans pour autant évoquer la « conscience ».

Les exemples d’avancées dans le domaine de l’intelligence artificielle ne manquent pas. Ainsi, une architecture récente, PathNet, utilise un algorithme génétique pour apprendre quel chemin, à travers ses nombreux réseaux neuronaux spécialisés, est le plus adapté à une tâche donnée. Cette architecture présente des performances robustes et flexibles, ainsi qu’une généralisation à travers les tâches, et pourrait constituer un premier pas vers une flexibilité de la conscience semblable à celle des primates.

Fin 2021, des scientifiques chinois ont développé une intelligence artificielle qui peut exécuter certaines tâches d’ordinaire effectuées par un procureur. Fiable à 97% (insuffisant pour certains experts), elle saurait reconnaître et porter des accusations pour huit des crimes les plus courants commis à Shanghai.

Plus récemment encore, le cofondateur et directeur scientifique d’OpenAI, Ilya Sutskever, a déclaré que les grands réseaux neuronaux d’aujourd’hui pourraient être « légèrement conscients ». Il y a un an, il affirmait : « Vous allez voir des systèmes beaucoup plus intelligents dans 10 ou 15 ans, et je pense qu’il est très probable que ces systèmes auront un impact complètement astronomique sur la société ».

Dès lors, attention aux dérapages catastrophiques que pourrait engendrer un développement massif de l’intelligence artificielle. En effet, tout outil puissant peut être utilisé pour de bonnes ou de mauvaises raisons. Dans le pire des cas, il pourrait « prendre le dessus » sur l’humain — un peu comme l’humain l’a fait avec l’animal —, ce qui nous rendrait quasiment obsolètes.

Même si les avancées scientifiques et technologiques pourraient l’envisager, l’intelligence artificielle n’est pas près de posséder une conscience dans le sens où nous le comprenons : une entité capable de réfléchir sur elle-même, d’inclure nos émotions dans le processus de décision rationnelle, etc. 7 millions d’années d’évolution du cerveau humain pourraient difficilement être remplacées par des algorithmes, aussi élaborés soient-ils. Pour autant, une autre forme de « conscience », de plus en plus évoluée, pourrait bien voir le jour.