Des chercheurs de l’EPFL (Lausanne) ont mis au point une méthode d’apprentissage automatique permettant de reproduire artificiellement le codage sensoriel effectué par la rétine. Elle pourrait un jour être appliquée aux implants rétiniens dans le but d’améliorer la qualité visuelle. La nouvelle approche consiste globalement à compresser les images d’une façon spécifique afin de préserver intégralement la qualité et la pertinence des informations visuelles.

La rétine est une petite membrane tapissée tout au fond du globe oculaire. Elle est composée de cellules photoréceptives dont le rôle est de transformer les signaux lumineux en signaux électriques, afin qu’ils soient transmis au cerveau par le nerf optique. La dégradation des photorécepteurs peut gravement compromettre la vision, et peut aller jusqu’à causer la cécité. Pour les personnes affectées par cette défaillance, les implants rétiniens représentent une solution potentielle pour remplacer artificiellement cette fonction. Les dispositifs actuels sont composés de plus d’un millier de microélectrodes, mais ne permettent de transmettre que des informations visuelles de basse qualité.

Toutefois, la conception de tels implants pose un défi majeur : le codage sensoriel. Il s’agit de la capacité à convertir efficacement les données environnementales captées en signaux que le cerveau peut interpréter. Le processus peut effectivement s’avérer complexe en raison du nombre restreint d’électrodes, limitant ainsi la quantité d’informations traitées.

La solution généralement adoptée est de compresser et d’optimiser les données sensorielles recueillies pour maximiser la quantité et la qualité des informations transmises sans surcharger le système ou réduire la fidélité des données. À cette fin, une équipe de chercheurs issus de divers établissements s’est tournée vers l’apprentissage automatique. Une de leurs récentes expériences montre un potentiel prometteur pour surmonter ce défi, en optimisant le processus de codage sensoriel. Les détails de l’étude ont été publiés dans la revue Nature Communications.

Deux groupes neuronaux distincts travaillant main dans la main

Concrètement, les chercheurs ont développé une méthode d’apprentissage automatique qu’ils ont appelé « actor-model framework ». Le système implique l’entraînement de deux groupes neuronaux qui travaillent en étroite collaboration. La première composante du framework est un réseau de neurones appelé « modèle » agissant comme un jumeau numérique de la rétine humaine. Ce modèle est entraîné à recevoir une image haute résolution et à la transformer en un code neuronal binaire. L’idée est de générer un code se rapprochant autant que possible du code neuronal généré par une rétine biologique en réponse à la même image. Pour y parvenir, les chercheurs lui ont appris à comprendre et à simuler le traitement complexe que la rétine naturelle effectue lorsqu’elle perçoit une image, incluant la gestion des contrastes, des couleurs et d’autres aspects visuels.

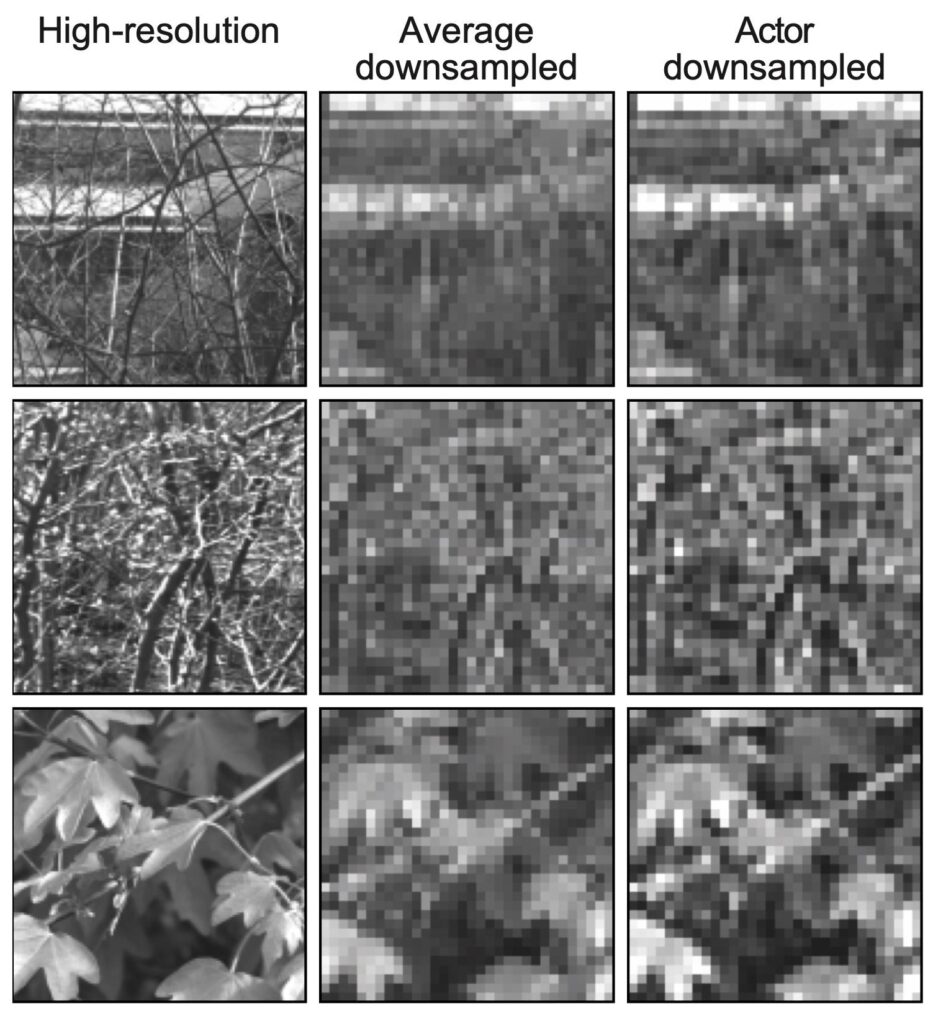

Le deuxième réseau neuronal, appelé « acteur », est entraîné à réduire le nombre de pixels d’une image haute résolution tout en préservant autant que possible les informations visuelles essentielles. Ce processus est appelé « sous-échantillonnage ». L’objectif de cet entraînement est d’apprendre à transformer une image haute résolution en une version sous-échantillonnée qui, une fois traitée par le modèle, produit un code neuronal aussi proche que possible de celui qu’une rétine biologique générerait en réponse à l’image originale non compressée.

Des expériences prometteuses

En vue de tester l’efficacité et la précision du système, les chercheurs ont effectué des expériences ex vivo en utilisant des rétines prélevées sur des cadavres de souris. Les résultats ont montré que les images traitées par leur méthode induisaient des réponses neuronales plus proches de celles générées par les images originales de haute résolution, comparées aux images compressées par des méthodes informatiques traditionnelles sans apprentissage automatique.

Suite à cet exploit, les chercheurs reconnaissent le potentiel de leur système dans d’autres applications. Le framework pourrait effectivement être adapté pour améliorer d’autres types de prothèses sensorielles ou neuroprothétiques, comme les implants auditifs ou les prothèses de membres. Cette approche pourrait optimiser la façon dont ces dispositifs codent et transmettent les informations sensorielles cérébrales. Néanmoins, des recherches supplémentaires sont nécessaires afin de définir si le système est sûr pour une utilisation dans des implants rétiniens humains et d’autres prothèses.