Au cours des dernières années, le développement d’algorithmes perfectionnés de machine learning a permis à l’intelligence artificielle d’atteindre des performances remarquables dans l’exécution de tâches et la résolution de problèmes complexes. Cependant, les machines ont toujours énormément de difficultés à effectuer des tâches basiques de la vie quotidienne. Pour le neuroscientifique Anthony Zador, afin de solutionner ce problème, il faut repenser l’intelligence artificielle en matière de réseaux de neurones basés sur des modèles de cerveaux d’animaux.

L’intelligence artificielle (IA) a encore beaucoup à apprendre du cerveau des animaux, explique Anthony Zador, neuroscientifique au Cold Spring Harbor Laboratory (CSHL). Il espère que les leçons tirées des neurosciences pourront aider la prochaine génération d’intelligence artificielle à surmonter des obstacles particulièrement difficiles.

Zador a consacré toute sa carrière à décrire, à partir du simple neurone individuel, les réseaux de neurones complexes qui constituent un cerveau vivant. Mais il a commencé sa carrière en étudiant les réseaux de neurones artificiels (ANN). Les ANN, qui sont les systèmes informatiques à la base de la récente révolution de l’IA, s’inspirent des réseaux de ramifications de neurones dans les cerveaux des animaux, dont les humains.

Des algorithmes de machine learning inefficaces pour la réalisation de tâches basiques

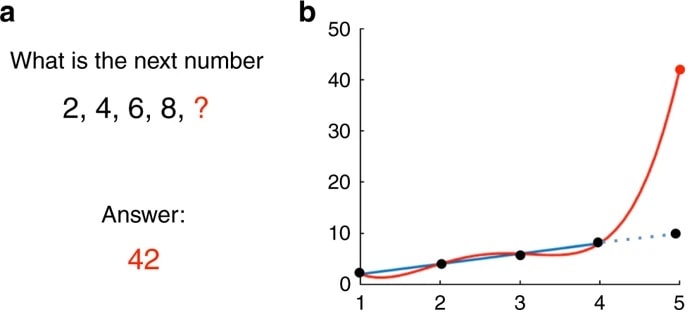

Dans un article publié dans la revue Nature Communications, Zador décrit comment des algorithmes d’apprentissage améliorés permettent aux systèmes d’intelligence artificielle d’atteindre des performances surhumaines pour un nombre croissant de problèmes plus complexes tels que les échecs et le poker. Pourtant, les machines ont toujours du mal à réaliser ce que nous considérons comme les tâches les plus simples de la vie quotidienne.

La résolution de ce paradoxe peut enfin permettre aux robots d’apprendre à faire quelque chose d’aussi naturel que de traquer une proie ou de construire un nid, ou même quelque chose d’aussi humain et banal que de faire la vaisselle, une tâche que le PDG de Google, Eric Schmidt, avait autrefois qualifiée de « demande de base… mais un problème extraordinairement difficile pour un robot ».

« Les choses que nous trouvons difficiles, comme la pensée abstraite ou les jeux d’échecs, ne sont pas réellement difficiles pour les machines. Les choses que nous trouvons faciles, comme interagir avec le monde physique, c’est ce qui est difficile pour elles. La raison pour laquelle nous pensons que c’est facile, c’est que nous avons eu un demi-milliard d’années d’évolution qui a organisé nos circuits neuronaux afin que nous puissions le faire sans effort » explique Zador.

Réseaux de neurones : optimiser l’IA en la basant sur le fonctionnement des cerveaux d’animaux

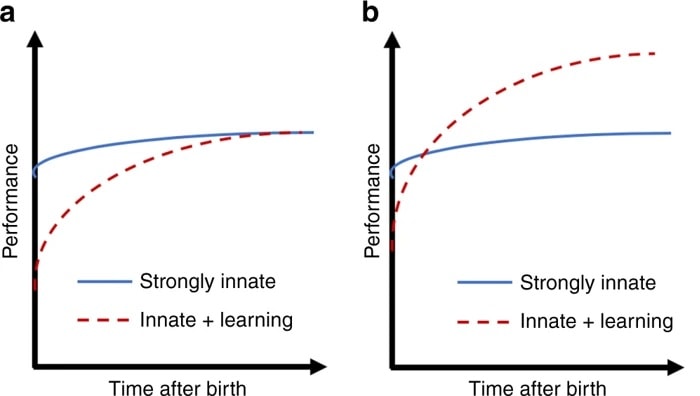

C’est pourquoi Zador écrit que le secret de l’apprentissage rapide n’est peut-être pas un algorithme d’apprentissage général perfectionné. Au lieu de cela, il suggère que les réseaux de neurones biologiques sculptés par l’évolution fournissent une sorte d’échafaudage facilitant l’apprentissage rapide et simple pour des types de tâches spécifiques, généralement ceux qui sont essentiels à la survie.

Sur le même sujet : Intelligence artificielle : elle est en route pour changer définitivement la recherche scientifique

« Vous avez des écureuils qui peuvent sauter d’arbre en arbre quelques semaines après la naissance, mais nous n’avons pas de souris qui apprennent la même chose. Pourquoi ? Parce que l’écureuil est génétiquement prédéterminé pour devenir une créature arboricole, alors que la souris non » déclare-t-il.

Zador suggère que l’un des résultats de cette prédisposition génétique est le circuit inné qui aide à guider l’apprentissage précoce d’un animal. Cependant, ces réseaux d’échafaudages sont beaucoup moins généralisés que l’apprentissage automatique que la plupart des experts de l’IA recherchent. Si les ANNs identifient et adaptent des ensembles de circuits similaires, affirme Zador, les robots ménagers du futur pourraient un jour nous surprendre avec une vaisselle propre.